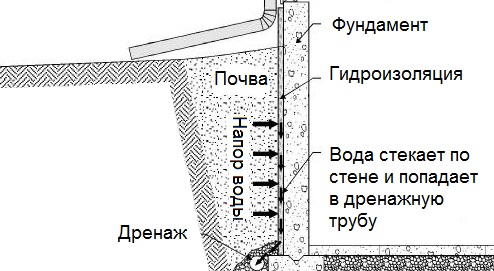

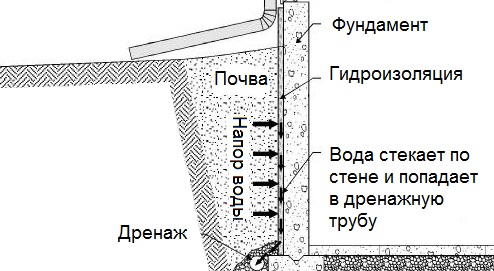

Общие условия выбора системы дренажа: Система дренажа выбирается в зависимости от характера защищаемого...

Археология об основании Рима: Новые раскопки проясняют и такой острый дискуссионный вопрос, как дата самого возникновения Рима...

Общие условия выбора системы дренажа: Система дренажа выбирается в зависимости от характера защищаемого...

Археология об основании Рима: Новые раскопки проясняют и такой острый дискуссионный вопрос, как дата самого возникновения Рима...

Топ:

Особенности труда и отдыха в условиях низких температур: К работам при низких температурах на открытом воздухе и в не отапливаемых помещениях допускаются лица не моложе 18 лет, прошедшие...

Основы обеспечения единства измерений: Обеспечение единства измерений - деятельность метрологических служб, направленная на достижение...

Характеристика АТП и сварочно-жестяницкого участка: Транспорт в настоящее время является одной из важнейших отраслей народного хозяйства...

Интересное:

Средства для ингаляционного наркоза: Наркоз наступает в результате вдыхания (ингаляции) средств, которое осуществляют или с помощью маски...

Аура как энергетическое поле: многослойную ауру человека можно представить себе подобным...

Что нужно делать при лейкемии: Прежде всего, необходимо выяснить, не страдаете ли вы каким-либо душевным недугом...

Дисциплины:

|

из

5.00

|

Заказать работу |

|

|

|

|

Лео Чалупа

Нейробиолог; вице-президент по исследовательской деятельности Университета Джорджа Вашингтона

Недавно продемонстрированные примеры выдающихся возможностей высокопроизводительных компьютеров замечательны, но неудивительны. При надлежащем программировании машины значительно превосходят людей в плане хранения и оценки больших объемов данных и принятия практически мгновенных решений. Это – мыслящие машины, потому что происходящие в них процессы аналогичны многим аспектам мышления человека.

Но в более широком понимании термин «мыслящая машина» употребляется неправильно. Ни одна машина не задается вечными вопросами: «Откуда я взялась? Зачем я здесь? Куда я иду?» Машины не думают о своем будущем, о своем неизбежном конце или о своем наследии. Чтобы размышлять над такими вопросами, требуется сознание и самосознание. У мыслящих машин их нет, и, учитывая наш нынешний уровень знаний, они вряд ли это получат в обозримом будущем.

Единственный реалистичный подход к созданию машины, сходной с человеческим мозгом, должен основываться на копировании нейронных цепей, лежащих в основе мышления. Более того, исследовательские программы, которые проводятся сейчас в Калифорнийском университете в Беркли, Массачусетском технологическом институте и еще в нескольких университетах, сосредоточены на достижении этой цели – построить компьютеры, работающие подобно коре головного мозга. Последние достижения в области исследования микроструктуры коры головного мозга стали серьезным стимулом, и вполне вероятно, что BRAIN[27] – новый проект Белого Дома – даст массу ценной информации. В ближайшие десятилетия мы узнаем о том, как взаимосвязаны миллиарды нейронов в каждом из шести слоев коры головного мозга, а также о типах функциональных цепей, формируемых такими связями.

|

|

Это необходимый первый шаг в разработке машин, способных к мышлению в том виде, который характерен для человеческого мозга. Но понимания микроструктуры коры недостаточно, чтобы построить умную машину. Что необходимо, так это понимание деятельности нейронов, лежащей в основе мыслительного процесса. Визуализирующие исследования обнаружили много новой информации об отделах головного мозга, вовлеченных в такие функции, как зрение, слух, осязание, страх, удовольствие и т. д.

Но у нас еще нет даже примерного понимания того, что происходит, когда мы размышляем. Причин тому множество, и среди них не последнюю роль играет наша неспособность изолировать мыслительный процесс от других физических состояний. Кроме того, различные мозговые цепи вполне могут быть связаны с различными модусами мышления. Когда мы думаем о предстоящей лекции, наш мозг задействуется не так, как когда мы вспоминаем о неоплаченных счетах.

В ближайшее время можно ожидать, что компьютеры будут превосходить людей во все большем количестве занятий. Но нам нужно намного лучше понимать работу человеческого мозга, чтобы создать по-человечески думающую машину. На данный момент нам не надо беспокоиться по поводу гражданских или любых других прав роботов, как не надо бояться, что они захватят власть. Если машина вдруг выйдет из под контроля, достаточно будет вытащить вилку из розетки.

Сингулярность – городская легенда?

Дэниел Деннет

Философ; профессор философии и содиректор Центра когнитивных исследований, Университет Тафтса; автор книги «Насос интуиции и другие инструменты мышления» (Intuition Pumps and Other Tools for Thinking)

Сингулярность – тот роковой момент, когда искусственный интеллект превзойдет своих создателей в разумности и захватит мир, – это мем, заслуживающий того, чтобы над ним поразмыслить. У него есть характерные признаки городской легенды: некоторое научное правдоподобие («Ну, в принципе, я полагаю, такое возможно!») и замечательная, вызывающая дрожь кульминационная фраза («Нами будут править роботы!»). «А ты знаешь, что если ты одновременно чихнешь, рыгнешь и пукнешь, то умрешь?» – «Да ладно, правда?» После десятилетий шумихи по поводу искусственного интеллекта можно было бы думать, что люди станут считать сингулярность шуткой, но, как оказалось, обеспокоенность общества этой идеей только растет. Добавьте несколько известных новообращенных – Илона Маска, Стивена Хокинга и Дэвида Чалмерса – к ряду других громких имен, и вы уже не можете не принимать ее всерьез. Когда случится это выдающееся событие – через десять, сто или тысячу лет? Может, благоразумнее будет уже сейчас начинать планировать, строить баррикады и повышать бдительность, высматривая предвестников катастрофы?

|

|

Я, напротив, думаю, что эти тревожные сигналы отвлекают нас от более насущной проблемы – от нависшего над нами бедствия, которое гораздо ближе и которому не нужна никакая помощь со стороны закона Мура или грядущих прорывов в теоретической науке. Мы в течение нескольких веков с огромным трудом постигали природу, сегодня накопленные знания позволяют нам впервые в истории контролировать многие аспекты наших судеб – и вот мы готовы отречься от этого контроля в пользу бездумных искусственных агентов и преждевременно поставить цивилизацию на автопилот. Соблазн поступить так коварен, потому что каждый следующий шаг сам по себе – предложение, от которого невозможно отказаться. Вы бы выглядели сегодня полным дураком, если б делали сложные арифметические вычисления с помощью карандаша и бумаги, тогда как карманный калькулятор намного быстрее и почти стопроцентно надежен (не забываем об ошибке округления). Зачем запоминать расписание поездов, когда его в любой момент можно посмотреть на смартфоне? Оставьте чтение карты вашему GPS-навигатору; да, он вовсе не умный, но он куда лучше вас справляется с задачей – не дает вам сбиться с маршрута.

Поднимемся выше по технологической лестнице: врачи все больше зависят от диагностических систем, которые объективно надежнее, чем любой специалист-человек. Вы бы хотели, чтобы ваш доктор отверг подготовленное машиной заключение, когда речь идет о выборе лечения для спасения вашей жизни? Это может оказаться лучшим – объективно наиболее успешным, непосредственно полезным – применением технологии, используемой в IBM Watson[28], и вопрос о том, можно ли считать этот компьютер разумным (или сознательным), к делу не относится. Если окажется, что Watson лучше, чем эксперты-люди, справляется с постановкой диагнозов на основе доступных данных, то нашей нравственной обязанностью будет пользоваться результатами его работы. Врач, который решает пренебречь рекомендациями такой машины, сам напрашивается на судебный иск о злоупотреблении служебным положением. По-моему, ни одна область человеческой деятельности не застрахована от использования таких протезов-оптимизаторов, и везде, где бы они ни появились, мы вынуждены делать выбор в пользу надежных результатов, а не человеческих отношений, как это было прежде. Рукотворные законы и даже рукотворная наука могут занять место рядом с кустарной керамикой и свитерами ручной вязки.

|

|

В самые первые дни существования искусственного интеллекта была предпринята попытка провести четкое различие между ИИ и когнитивным моделированием. Предполагалось, что первый станет отраслью инженерного дела и будет работать как угодно, не пытаясь подражать человеческим мыслительным процессам, кроме тех случаев, когда это окажется эффективным. Когнитивное моделирование, напротив, представляло собой дополнение к психологии и нейробиологии. Модель когнитивного моделирования, которая убедительно продемонстрировала бы характерные человеческие ошибки или затруднения, стала бы триумфом, а не провалом. Такое различие в стремлениях продолжает существовать, но почти стерлось из общественного сознания. Для дилетантов искусственный интеллект – это штука, способная пройти тест Тьюринга. Недавние достижения в области ИИ стали в основном результатом того, что мы отказались от моделирования человеческих мыслительных процессов (которые, как мы думали, мы понимаем) и перешли к использованию удивительных возможностей суперкомпьютеров для майнинга данных, чтобы извлечь оттуда важные связи и паттерны. При этом мы уже не пытаемся сделать так, чтобы компьютеры понимали, что делают. По иронии судьбы, такие впечатляющие результаты побуждают многих когнитивистов пересмотреть свою позицию; оказывается, что надо еще многое узнать о том, как мозг осуществляет свою блестящую работу по «продуцированию будущего», и в этом нам помогут методы машинного обучения и майнинга данных.

|

|

Но общественность будет упорно предполагать, что любой черный ящик, который способен проделывать такие штуки (безотносительно последних успехов в области разработки искусственного интеллекта), – это разумный агент, во многом похожий на человека, тогда как на самом деле то, что находится в ящике, – это причудливо нарезанная двумерная ткань, сила которой как раз в том и заключается, что у нее нет надстройки в виде человеческого разума со всеми его особенностями: склонностью отвлекаться, волноваться, испытывать эмоции, переживать воспоминания и строить личные привязанности. Это вообще не гуманоидный робот, а бездумный раб, последняя модель автопилота.

В чем проблема с тем, чтобы передать нудную мыслительную работу таким высокотехнологичным штуковинам? Да ни в чем, при условии, что (1) мы не будем сами себя вводить в заблуждение, и (2) нам как-то удастся не допустить атрофии собственных познавательных навыков.

1. Очень-очень трудно принять свойственные нашим помощникам ограничения и не забывать о них, равно как и не забывать о склонности человека всегда приписывать компьютерам разумность, как мы знаем еще со времен печально известной программы «Элиза», написанной Йозефом Вайценбаумом в 1960-х годах. Это очень опасно, ведь мы всегда будем испытывать желание требовать от них большего, чем то, для чего мы их создали, а также доверять полученным ими результатам, когда этого лучше не делать.

2. Используй или потеряешь. Поскольку мы все сильнее зависим от когнитивных протезов, то рискуем стать беспомощными, если они когда-нибудь перестанут работать. интернет – не разумный агент (ну, в каком-то смысле, может, и разумный), но мы тем не менее стали настолько от него зависеть, что, если бы он вдруг сломался, началась бы такая паника, что общество оказалось бы уничтожено за несколько дней. Кстати, к предупреждению этого события нам надо сейчас приложить все усилия, потому что оно может произойти в любой момент.

Реальная опасность – это не те машины, которые станут умнее нас и узурпируют роль хозяев наших судеб. Реальная опасность – это машины, по сути безмозглые, но наделенные нами полномочиями, значительно превосходящими уровень их компетентности.

Наноинтенциональность

|

|

Уильям Текумсе Фитч

Преподаватель когнитивной биологии в Венском университете; автор книги «Эволюция языка» (The Evolution of Language)[29]

Несмотря на огромный прирост вычислительной мощности, нынешние компьютеры думают не так, как это делаем мы (или шимпанзе, или собаки). У основанных на кремнии компьютеров отсутствует важнейшая способность органического разума – способность изменять свою материальную форму и, следовательно, свои будущие вычисления в ответ на события, происходящие в мире. Без этой способности (которую в других работах я назвал наноинтенциональностью), с одной только обработкой данных, нельзя получить мысль, потому что у вычисляемых символов и значений отсутствует какая-либо внутренняя причинно-следственная связь с реальным миром. Любая информация, полученная в результате работы кремниевого процессора, нуждается в интерпретации людьми, чтобы обрести значение, и так все останется и в обозримом будущем. У нас мало причин для того, чтобы бояться разумных машин, куда больше их для того, чтобы бояться все более неразумных людей, которые их используют.

В чем именно выражается особенность биологического, а не кремниевого компьютера? Не бойтесь, я не имею в виду какой-то мистический élan vital[30]. Это наблюдаемая, механистическая особенность живых клеток – особенность, которая развилась посредством обычных эволюционных процессов. В моих построениях нет никакой мистики или «незримого духа». По сути, наноинтенциональность – это способность клеток отвечать на изменения в окружающей среде, перестраивая свои молекулы и, таким образом, изменяя форму. Это свойство есть у амебы, хватающей бактерию, у мышечной клетки, повышающей уровень миозина в ответ на пробежку, или (что наиболее актуально) у нейрона, вытягивающего свои дендриты в качестве реакции на локальную нейровычислительную среду. Наноинтенциональность – основная, непреодолимая, бесспорная особенность жизни на Земле, которой нет у печатных кремниевых микросхем, формирующих «сердце» современного компьютера. Поскольку такое физическое различие между мозгом и компьютером – простой и грубый факт, то остается открытым вопрос: насколько большое значение он имеет для более абстрактных философских проблем, касающихся понятий мысли и значения. И тут ситуация становится сложнее.

Философские обсуждения начинаются с утверждения Канта о том, что наш разум неизменно отделен от типичных объектов наших размышлений – физических сущностей в реальном мире. Мы получаем сведения о них (через фотоны, воздушные колебания или испускаемые молекулы), но наш разум/мозг никогда не вступает с ними в прямой контакт. Таким образом, вопрос о том, как можно утверждать, что сущности нашего разума (мысли, убеждения, желания) якобы направлены на вещи в реальном мире, оказывается неожиданно сложен. Действительно, направленность – это центральная проблема в философии сознания, основа многолетней полемики между такими философами, как Деннет, Фодор и Сёрл. Философы несильно помогли внести ясность, назвав эту мнимую умственную направленность интенциональностью (не путать с обычным значением слова в английском языке: «делать что-то нарочно, умышленно»). Вопросы интенциональности тесно связаны с глубинными проблемами феноменологии сознания, часто выражаемыми терминами «квалиа» и «трудная проблема сознания»[31], но они обращены к более простому и фундаментальному вопросу: как может ментальная сущность (мысль – паттерн нервного возбуждения) быть в любом смысле этого слова связана со своим объектом (вещью, которую вы видите, или человеком, о котором вы думаете)?

Вот ответ скептика, солипсиста: такой связи нет, интенциональность – иллюзия. Это заключение ложно по крайней мере в одной важнейшей области (замечание сделано Шопенгауэром 200 лет назад): единственным местом, где ментальные явления (желания и намерения, что инстанцируется в нервном импульсе) вступают в контакт с реальным миром, являются наши собственные тела (например, нейромышечное соединение). Пластичность живой материи в целом и нейронов в частности означает, что петля обратной связи непосредственно соединяет наши мысли с нашими действиям, просачиваясь обратно через восприятие, где влияет на структуру самих нейронов. Петля каждый день замыкается в нашей голове (в самом деле, если вы завтра вспомните хоть что-нибудь об этом эссе, то лишь потому, что некоторые нейроны в вашем мозгу изменили свою форму, ослабив или усилив синапсы, расширив или сократив число связей). Такой контур обратной связи в принципе не может замкнуться в жестком кремниевом чипе. Это биологическое качество обеспечивает умственную деятельность у человека (а также у шимпанзе и собаки) с присущей ей внутренней интенциональностью, которой нет у современных кремниевых вычислительных систем.

Если утверждение верно (а мои логика и интуиция его поддерживают), машины «думают», «знают» или «понимают» что-либо только в той мере, в какой это делают их создатели и программисты, когда значение добавляется интенциональным, истолковывающим агентом, обладающим мозгом. Любой «интеллект» у компьютера – это исключительно интеллект работающих с ним людей.

Поэтому я не боюсь, что роботы восстанут или начнут бороться за свои права (если только их защитой не решат заняться заблуждающиеся люди). Означает ли это, что можно не беспокоиться до тех пор, пока кто-то не изобретет компьютер с наноинтенциональностью? К сожалению, нет: существует другая опасность, которая исходит от нашей чрезмерной склонности ошибочно приписывать намерение и понимание неодушевленным предметам («Моей машине не нравится низкооктановое топливо»). Думая так о вычислительных артефактах – компьютерах, смартфонах, системах управления, – мы постепенно передаем им (и тем, кто их контролирует) свою обязанность – информированное, компетентное понимание. Ситуация становится опасной, когда мы охотно и с ленцой уступаем ее бесчисленным кремниевым системам (автомобильным навигаторам, смартфонам, системам электронного голосования), которые не только не задумываются о том, что именно они вычисляют, но даже и не знают об этом. Глобальный финансовый кризис дал нам почувствовать, что может произойти в мире, связанном компьютерами, когда реальная ответственность и реальные компетенции окажутся неблагоразумно свалены на машины.

Я боюсь не успешного восстания искусственных интеллектов, а скорее катастрофического сбоя, вызванного множеством мелких ошибок в кремниевой системе, которую наделили слишком большими полномочиями. Нам все еще далеко до сингулярности, когда компьютеры станут умнее нас, но это не значит, что нам не следует беспокоиться о глобальном сетевом коллапсе. Чтобы сделать первый шаг к предотвращению таких катастроф, нужно перестать перекладывать на компьютеры собственную ответственность и понять и принять простую истину: машины не думают. А то, что мы принимаем за их мышление, становится с каждым днем все опаснее.

Игры (и пророчества) разума

Ирэн Пепперберг

Научный сотрудник и преподаватель, кафедра психологии, Гарвардский университет; автор книги «Алекс и я» (Alex & Me)

Машины великолепно справляются с вычислениями, но при этом не очень хорошо – с мышлением как таковым. У машин бесконечный запас упорства и настойчивости, и, как кое-кто говорит, они могут легко разгрызть сложную математическую проблему или помочь вам проехать через пробки в незнакомом городе, но все это – благодаря алгоритмам и программам, созданным людьми. Чего же машинам не хватает?

Машинам не хватает ви́дения (по крайней мере пока, и я не думаю, что наступление сингулярности это изменит). Я имею в виду отнюдь не зрение. Компьютеры не сами придумывают новое приложение, которому суждено стать популярным. Компьютеры не принимают решение исследовать далекие галактики – они прекрасно справятся с задачей, когда мы их туда отправим, но это уже другая история. Компьютеры, конечно, лучше среднестатистического человека работают в области высшей математики и квантовой механики, но у них нет видения, чтобы в принципе обнаружить необходимость в таких действиях. Машины могут выигрывать у людей в шахматы, но они еще не изобрели интеллектуальную игру, что займет человечество на столетия. Машины видят статистические закономерности, которые пропустит мой слабый мозг, но они не в состоянии выдвинуть новую идею, что соединит разрозненные наборы данных и создаст новую область науки.

Я не так уж сильно беспокоюсь по поводу машин, способных вычислять. Я как-нибудь переживу постоянные вылеты браузера, но пусть у меня будет умный холодильник, способный отслеживать RFID-коды лежащих в нем и вынимаемых из него продуктов и посылать мне СМС с напоминанием купить сливки по пути домой (пользуясь случаем, обращаюсь к тем, кто работает над такой системой: поторопитесь!). Мне нравится, когда компьютер подчеркивает незнакомые ему слова, и пусть среди них иногда оказывается какая-нибудь «филогенетика», я могу находить опечатки в общеупотребительных словах (и прямо сейчас он тоже не позволяет мне писать с ошибками). Но эти примеры показывают: само по себе то, что машина демонстрирует нечто похожее на мышление, еще не означает, что она на самом деле мыслит – или, по крайней мере, что она мыслит подобно человеку.

Мне вспоминается одно из самых первых исследований в области обучения обезьян использованию языка – где они должны были манипулировать пластиковыми фишками, чтобы отвечать на разные вопросы. Впоследствии эксперимент повторили со студентами, которые – что неудивительно – исключительно преуспели в освоении системы, но когда их спросили, чем они занимались, те сказали, что решали какие-то интересные головоломки и понятия не имели, что их обучали языку. Последовало широкое обсуждение, и мы многое открыли и многому научились в ходе новых исследований. Несколько особей, не являющихся людьми, смогли понять референтное значение различных символов, пользоваться которыми их учили, и мы многое узнали об интеллекте обезьяны в рамках оригинальной методологии. Смысл этой истории таков: то, что первоначально казалось сложной лингвистической системой, потребовало намного большей подготовки, чем предполагалось изначально, чтобы стать чем-то большим, нежели серия относительно простых парных ассоциаций.

Так что меня беспокоят не мыслящие машины, а самодовольное общество, готовое отказаться от своих мечтателей в обмен на возможность не делать трудную работу. Люди должны воспользоваться собственными познавательными мощностями, которые освободились, когда машины взяли на себя грязную работу, быть благодарными за такую свободу и использовать ее, направляя свои способности на решение сложных насущных проблем, для которых требуется проницательность и пророческое видение.

Колосс – это БДВ

[32]

Николас Хамфри

Почетный профессор психологии Лондонской школы экономики; преподаватель философии, Новый колледж гуманитарных наук; старший член Колледжа Дарвина, Кембриджский университет; автор книги «Сознание: Пыльца души» (Soul Dust: The Magic of Consciousness)[33]

Если я дам вам один цент, вы скажете, о чем задумались? Не обязательно отвечать, смысл сказанного мною заключается в том, что вы как сознательный субъект это можете. Значит, у вас есть доступ к интроспекции. Вы знаете – и можете сказать, – что происходит на сцене в театре вашего разума. А как насчет машин? Если дать мыслящей машине один биткоин, она скажет, о чем задумалась? Никому еще не удалось создать машину, способную на такое. Витгенштейн заметил, что, если бы лев умел говорить, мы бы его не поняли. Если бы компьютер умел говорить, ему нечего было бы сказать. Что я могу сказать о мыслящих машинах? Все просто. Я не думаю, что на данный момент такие машины существуют.

Конечно, ситуация может скоро измениться. В далеком прошлом в ходе естественного отбора обнаружилось, что, с какими бы конкретными проблемами ни столкнулся человек, наличие мозга, способного к интроспекции[34], имеет практические преимущества. Так что люди, которые программируют машины, вполне могут прийти к мысли, что раз это работает с нами, то сработает и с компьютерами – если те столкнутся с проблемами, для решения которых нужна интроспекция. Но что это за проблемы и почему я говорю про какой-то театр сознания?

Театр открывает вам секрет: он позволяет вам видеть, как работает ваш собственный разум. Наблюдая, например, как убеждения и страсти порождают желания, которые приводят к действиям, вы начинаете догадываться, почему вы думаете и действуете так, а не иначе. Благодаря этому вы можете объяснить себя себе, а также другим людям. Но не менее важно и то, что у вас есть модель для понимания других людей. Интроспективное мышление заложило основы для того, что психологи называют моделью психического.

Для человека как вида, у которого социальный интеллект – ключ к биологическому выживанию, преимущества такого мышления огромны. Для машин же успех в социальной жизни еще не стал проблемой, поэтому у них не было причин идти тем же путем, что и мы. Однако, несомненно, наступит то время, когда у машин возникнет необходимость понимать психологию других машин, чтобы иметь возможность работать бок о бок с ними. К тому же если им нужно будет эффективно сотрудничать с людьми, то придется также понимать и человеческую психологию. Я предполагаю, что именно тогда разработчики – или, возможно, сами машины – последуют примеру природы и создадут цифровую версию интроспекции.

Есть ли опасность того, что, едва перейдя эту черту, проницательные машины начнут понимать людей уже слишком хорошо? Психопатам иногда приписывается не слабое, а напротив, очень хорошее понимание человеческой психологии. Стоит ли нам бояться чего-то подобного в случае с машинами?

Я так не думаю. Эта ситуация не нова. Тысячелетиями люди отбирали и программировали особый вид биологических машин, которые действовали и действуют в качестве наших слуг, спутников и помощников. Я говорю о домашних собаках. Замечательным результатом стало то, что современные собаки, по сути, приобрели особую, хорошо выраженную способность читать чужие мысли – как других собак, так и людей – самую сильную среди остальных животных, не считая самих людей. Очевидно, что наши отношения с собаками развивались как взаимовыгодное партнерство, а не как соревнование, даже притом что руководящая роль оставалась за нами. Если настанет такой момент, когда машины научатся настолько же хорошо читать мысли человека, как это делают сейчас собаки, нам, конечно, придется следить, чтобы они не вели себя чересчур по-хозяйски, чтобы не манипулировали нами и другими машинами и чтобы не безобразничали – точно так же, как мы следим за нашими четвероногими друзьями. Но я не вижу причин сомневаться в том, что мы потеряем контроль.

Есть картина Гойи, изображающая ужасного Колосса, который идет по земле на фоне бегущих в ужасе людей. «Колоссом» (Colossus) была названа и одна из первых вычислительных машин Алана Тьюринга. Имеет ли смысл воображать себе угрозу существованию человечества, исходящую от потомков этого компьютера? Нет, я предпочитаю смотреть на вещи оптимистически. Если повезет, вернее, если мы все сделаем правильно, Колосс останется большим и добрым великаном.

Искусственный интеллект с самосознанием? Не в этом тысячелетии!

Рольф Добелли

Основатель «Цюрихских умов»; журналист; автор книги «Искусство мыслить ясно» (Die Kunst des Klaren Denkens)[35]

Широко распространенная обеспокоенность по поводу того, что искусственный интеллект может поставить под угрозу существование человечества и захватить мир, иррациональна. И вот почему.

Чисто теоретически системы автономного или искусственного интеллекта могут развиваться по двум направлениям: либо как расширение человеческого разума, либо как совершенно новая форма мышления. Назовем первое «гуманитарным» ИИ, а второе – «иным» ИИ.

Почти все формы ИИ сегодня – «гуманитарные». Мы используем их, чтобы решать задачи, слишком сложные, трудоемкие или скучные для наших ограниченных мозгов: это управление электросетями, рекомендательные сервисы, беспилотные автомобили, системы распознавания лиц, трейдинговые алгоритмы и т. п. Такого рода искусственные агенты работают в узких областях с ясными задачами, установленными разработчиками. «Гуманитарный» искусственный интеллект нацелен на достижение человеческих целей – он способен достичь их зачастую лучше, чем это сделали бы люди, с меньшим количеством ошибок, не отвлекаясь, не срываясь и не уставая. Через несколько десятилетий ИИ-агенты, возможно, будут выступать в качестве виртуальных продавцов страховых полисов, врачей, психотерапевтов и даже виртуальных супругов и детей.

Но такие ИИ-агенты останутся нашими рабами, не имеющими никакого представления о самих себе. Они будут с удовольствием выполнять функции, на которые мы их настроим. На нашей совести останутся возможные сбои из-за программных ошибок или излишней уверенности пользователей в этих агентах (о чем говорит Дэн Деннетт). Да, «гуманитарный» искусственный интеллект не раз удивит нас новыми решениями конкретных задач оптимизации. Но в большинстве случаев новые решения – это последнее, чего мы хотим от машины (креативный подход к наведению ракеты с ядерным зарядом – как вам такое?). В связи с этим «гуманитарные» ИИ будут всегда соответствовать своей узкой области. Они всегда останутся понятными, ведь мы знаем, как они устроены и для каких задач созданы. Иногда из-за все время вносимых изменений программный код будет становиться слишком большим и нечитаемым для одного человека. В таких случаях придется переписывать его с нуля. «Гуманитарный» искусственный интеллект приблизит нас к давней мечте, где роботы делают большую часть работы, в то время как освободившиеся люди занимаются творчеством – или умирают от скуки.

«Иной» искусственный интеллект совершенно не похож на «гуманитарный». «Иной» ИИ, очевидно, представляет опасность для человечества: он может захватить планету, перехитрить нас, превзойти, поработить – а мы даже и не заметим нападения. Каким именно будет «иной» интеллект? По определению, мы не можем этого знать. Он освоит функции, которые мы неспособны понять даже приблизительно. Будет ли ему присуще сознание? Скорее всего, оно ему не понадобится. Будет ли он испытывать эмоции? Будет ли он писать романы-бестселлеры? Если да, то кто их станет покупать: мы или он сам и его порождения? Будут ли когнитивные ошибки искажать его мышление? Будет ли он общительным? Разработает ли него собственную модель психического? Если да, то будет ли он шутить, сплетничать, волноваться о своей репутации, стремиться к сплоченности на фоне внешних угроз? Создаст ли свою собственную версию искусственного интеллекта (искусственный ИИ)? Мы не знаем.

Все, что нам известно, так это то, что люди неспособны создать по-настоящему «иное» мышление. Что бы мы ни придумали, оно будет отражать наши цели и ценности, а потому это «что-то» не сильно отклонится от человеческого мышления. Нам понадобилось бы пережить настоящую эволюцию, а не просто разработать эволюционные алгоритмы, чтобы на свет появился «иной» искусственный интеллект. Для этого нам пришлось бы пройти совершенно другой путь развития, радикально отличающийся от того, который привел к появлению человеческого интеллекта и «гуманитарного» ИИ.

Как же нам сделать так, чтобы заработала настоящая эволюция? Для этого нужны репликаторы, изменчивость и отбор. Как только все три компонента начнут работать, неизбежно возникнет эволюция. Насколько вероятно, что в результате ее разовьется «иной» интеллект? Вот вам кое-какие мои вычисления «на коленке».

Для начала прикинем, во что обошлось развитие невероятно сложных эукариотических клеток до мыслящих существ человеческого уровня. Этот процесс потребовал использования значительной части биомассы Земли (примерно 500 миллиардов тонн связанного эукариотами углерода) в течение приблизительно 2 миллиардов лет. Огромный объем эволюционной работы! Правда, мышление, сравнимое с человеческим, может появиться и за половину этого времени, даже за 10 процентов, если очень повезет, но вряд ли быстрее. Чтобы эволюция породила сложное поведение, нужно не только много времени, но и чашка Петри размером с поверхность Земли.

Предположим, что «иной» интеллект будет основан на кремнии, как весь современный ИИ. Эукариотическая клетка значительно сложнее, чем, скажем, чип самого современного центрального процессора Intel Core i7, как в плане аппаратного, так и в плане программного обеспечения. Далее, предположим, что нам удалось уменьшить такой чип до размеров эукариота. Оставим без внимания квантовые эффекты, которые помешают при этом надежной работе транзисторов. Не будем также касаться вопроса об источнике энергии. Нам пришлось бы покрыть земной шар 1030 микроскопических процессоров и позволить им общаться и бороться за выживание в течение 2 миллиардов лет, чтобы появилось настоящее мышление.

Да, скорость обработки данных у процессоров выше, чем у биологических клеток, потому что электроны перемещать легче, чем атомы. Но у эукариотов атомы работают массово-параллельно, тогда как электроны у четырехъядерного Intel Core i7 – только по четырем параллельным линиям. В конечном счете – по крайней мере, для того чтобы доминировать в мире, – этим электронам придется перемещать атомы, чтобы хранить свои программы и данные во все большем числе физических мест. А значит, их развитие существенно замедлится. Трудно сказать, будет ли кремниевая эволюция в целом быстрее, чем биологическая. Мы недостаточно знаем об этом. Я думаю, по скорости она может превосходить биологическую максимум на два-три порядка (если вообще будет превосходить), что приведет к появлению обладающего самосознанием «иного» интеллекта примерно через миллион лет.

Давайте представим другой сценарий: что, если «гуманитарный» ИИ станет настолько умным, что сможет самостоятельно создать «иной» ИИ? Тут вступает в силу второе правило Лесли Орджела: «Эволюция умнее, чем ты». Она умнее человеческого мышления. Она даже умнее, чем «гуманитарный» ИИ. И она намного медленнее, чем вам кажется.

Таким образом, риски, связанные с искусственным интеллектом, не являются его характерной чертой, а происходят из нашей склонности чересчур на него полагаться. Искусственный интеллект не эволюционирует в самосознание при нашей жизни. Этого не произойдет и через тысячу лет.

Я, конечно, могу ошибаться. Все-таки, мои вычисления «на коленке» предполагают применение устаревшего человеческого мышления для осмысления «иного» ИИ, который для нас, по определению, непостижим. Но это все, что мы можем сделать на данном этапе.

Где-то в конце 1930-х годов Сэмюэл Беккет записал в дневнике: «Мы ощущаем с удивительным смирением, что разум – не сверхчеловеческий дар… что разум эволюционировал в то, что он теперь из себя представляет, но его развитие могло, однако, пойти иначе». Замените «разум» на «искусственный интеллект» – и получите мой вывод.

|

|

|

Биохимия спиртового брожения: Основу технологии получения пива составляет спиртовое брожение, - при котором сахар превращается...

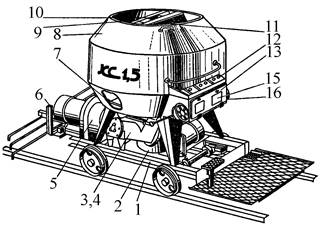

Кормораздатчик мобильный электрифицированный: схема и процесс работы устройства...

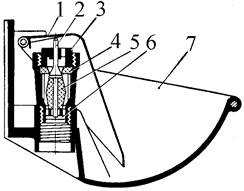

Индивидуальные и групповые автопоилки: для животных. Схемы и конструкции...

Папиллярные узоры пальцев рук - маркер спортивных способностей: дерматоглифические признаки формируются на 3-5 месяце беременности, не изменяются в течение жизни...

© cyberpedia.su 2017-2024 - Не является автором материалов. Исключительное право сохранено за автором текста.

Если вы не хотите, чтобы данный материал был у нас на сайте, перейдите по ссылке: Нарушение авторских прав. Мы поможем в написании вашей работы!