Индивидуальные и групповые автопоилки: для животных. Схемы и конструкции...

Состав сооружений: решетки и песколовки: Решетки – это первое устройство в схеме очистных сооружений. Они представляют...

Индивидуальные и групповые автопоилки: для животных. Схемы и конструкции...

Состав сооружений: решетки и песколовки: Решетки – это первое устройство в схеме очистных сооружений. Они представляют...

Топ:

Характеристика АТП и сварочно-жестяницкого участка: Транспорт в настоящее время является одной из важнейших отраслей народного хозяйства...

Особенности труда и отдыха в условиях низких температур: К работам при низких температурах на открытом воздухе и в не отапливаемых помещениях допускаются лица не моложе 18 лет, прошедшие...

Когда производится ограждение поезда, остановившегося на перегоне: Во всех случаях немедленно должно быть ограждено место препятствия для движения поездов на смежном пути двухпутного...

Интересное:

Распространение рака на другие отдаленные от желудка органы: Характерных симптомов рака желудка не существует. Выраженные симптомы появляются, когда опухоль...

Аура как энергетическое поле: многослойную ауру человека можно представить себе подобным...

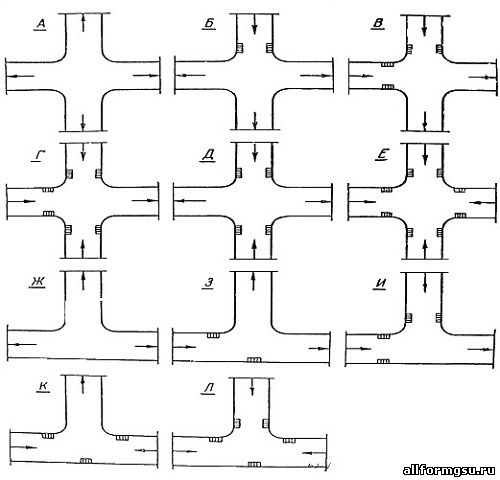

Искусственное повышение поверхности территории: Варианты искусственного повышения поверхности территории необходимо выбирать на основе анализа следующих характеристик защищаемой территории...

Дисциплины:

|

из

5.00

|

Заказать работу |

|

|

|

|

1а. Функция энтропии была введена в термодинамику Р.Клаузиусом, предложившим исчислять превращение энтропии по формуле:

| D S = | D Q | (1.1) |

| T |

где S - энтропия;

Q - количество тепла;

Т - абсолютная температура.

При передаче тепла D Q от более разогретого тела с температурой Т1 к менее разогретому телу с температурой Т2 превращение

энтропии D S равно:

| D S = | - D Q | + | + D Q | (1.2) |

| T 1 | T2 |

Из формулы (1.2) с учетом условия T1 > T2 следует вывод:

| D S > 0 | (1. 3) | |

Поскольку во всех физических процессах тепло перетекает самопроизвольно от более разогретых к менее разогретым телам, условие (1.3) приобретает силу физического закона, получившего название Второго начала термодинамики.

Пока существует разность температур T1 – T2, часть теплового потока может быть преобразована в полезную (антиэнтропийную) энергию либо в естественно протекающих процессах (например, биологических), либо с помощью тепловых машин.

При условии T1 = T2 энергия полностью утрачивает свои антиэнтропийные свойства. Этот вывод был положен в основу теории тепловой смерти Вселенной.

Заметим, что сам термин «энтропия» был введен Клаузиусом, образовавшим его от корня греческого слова «тропе», означающего «превращение» с добавлением заимствованной из слова «энергия» приставки «эн-».

1б. Предложенная Клаузиусом формула энтропии (1.1) не раскрывала внутренних механизмов процессов, приводящих к возрастанию энтропии.Эта задача была решена Л.Больцманом, предложившим исчислять энтропию идеального газа по формуле:

| S = K H | (1. 4) | |

где K= 1,38 · 10 -16 эрг/градус – коэффициент Больцмана

Н - математическая энтропия.

Согласно Больцману, величина H определяется так:

|

|

| H = ln | N! | (1. 5) |

| N1 ! N2 ! … Nk ! |

где N - общее число молекул газа, находящегося в рассматриваемом объеме.

Ni - число молекул, движущихся со скоростями, соответствующими i -ой ячейке условного пространства скоростей.

При этом 1= 1,2,... К (1.6)

Условие (1.6) означает, что все N молекул распределены по соответствующим ячейкам пространства скоростей, в количествах N1, N2, … Nk,, учитываемых уравнением (1.5)

Согласно (1.5) перестановка молекул, находящихся внутри каждой из ячеек, не влияет на величину Н. Отсюда следует, что подсчитанная по формуле (1.5) величина Р соответствует числу возможных микросостояний системы (в частности газа), при котором макросостояние системы остается неизменным.

1в. М.Планк преобразовал формулу Больцмана (1.5), использовав для этого математическую формулу Стирлинга, справедливую для больших значений N:

| ln(N!) = Nln N – N | (1.7) |

В результате подстановки (1.7) в (1.5) получается соотношение:

| H = Nln N – N –(S Ni ln Ni – S Ni) | ||||

| i | i | |||

С учетом условия S Ni = N, выражение для Н приводится к виду:

| H = Nln N –S Ni ln Ni | (1.8) | ||

| i | |||

Далее Планк ввел в рассмотрение вероятности различных состояний молекул, определив их как:

| pi = | Ni | (1. 9) |

| N |

При этом второе слагаемое в правой части (1.8) можно представить как:

| S Ni ln Ni =S pi N (ln pi + ln N) = N S pi ln pi + N ln N Si pi | (1.10) | |||||||

| i | i | i | i | |||||

С учетом известного из теории вероятностей условия нормировки S pi = 1, подстановка (1.10) в (1.8) приводит выражение для Н к окончательному виду:

| H = –S pi ln pi | (1.11) | ||

| i | |||

Проделанные Планком с помощью формулы Стирлинга чисто формальные преобразования не только позволили получить новое выражение для исчисления энтропии, но помогли более глубоко осознать смысл вычисляемой величины Н. Выражение (1.11) позволяет сделать два важных вывода:

1. Введение в формулу энтропии значений вероятностей расширило рамки применимости этой формулы далеко за пределы исследуемых термодинамикой молекулярных систем. Символ pi может обозначать вероятность не только тех или иных состояний молекул, но и различных состояний элементов любых систем (в частности, вероятностей появления букв текста или других символов передаваемых сообщений).

|

|

2. Выражение (1.11) соответствует полной энтропии системы. Поделив подсчитанную по формуле (1.11) величину на Ni, можно определить усредненную величину энтропии Н, относящуюся к одному элементу рассматриваемой системы, т.е.

|

| (1.8) | ||||

| H = –S pi ln pi | |||||

|

| i | ||||

Именно в таком виде использовал функцию энтропии Шеннон для определения среднего значения энтропии одной буквы текста (опуская при этом знак усреднения).

1г. Согласно Шеннону, средняя энтропия одной буквы текста вычисляется по формуле (1.2) путем суммирования слагаемых pi log pi, в которых символом pi, обозначены вероятности соответствующих букв. Таким образом:

| i=я | (1.13) | ||

| H = –S pi ln pi = - (pа log pа + pб log pб +…+ pя log pя) | |||

| i=а | |||

Для удобства исчисления энтропии сообщений, передаваемых двоичным кодом, Шеннон заменил используемый термодинамикой натуральный логарифм ln двоичным логарифмом log2.

МЕТОДЫ ИСЧИСЛЕНИЯ КОЛИЧЕСТВА СТРУКТУРНОЙ ИНФОРМАЦИИ И ИНФОРМАЦИОННОЙ ЭНТРОПИИ ТЕКСТОВ

До опубликования созданной К.Шенноном теории Р.Хартли предложил определять количество информации по формуле:

| I = log2 N | (2.1) |

где I - количество информации;

N - число возможных (ожидаемых) сообщений.

Для учета различной степени неожиданности (вероятности) сообщений К.Шеннон предложил использовать заимствованную из статистической физики вероятностную функцию энтропии, приведенную к виду (1.13)

В случае равной вероятности появления любой из N букв алфавита выполняется условие:

| Pа = Pб = Pв = … = Pя = 1/N | (2.2) |

В результате подстановки (2. 2) в (2.1) и с учетом того, что:

- log1/N = + log N

получаем:

| H = – ( | 1 | log | 1 | )=log N | (2.3) |

| N | N |

Сопоставляя (2. 1) и (2.3), приходим к выводу, что количество информации, вычисляемое по формуле Хартли, соответствует устранению неопределенности Н при получении сообщения об одной из букв алфавита, при условии равной вероятности появления любой из букв (условие 2.2).

При равных вероятностях появления всех букв алфавита текст становится наиболее хаотичным. Подсчитанная по формуле (2.3) величина информационной энтропии достигает максимальной величины:

|

|

| Hmax = log N | (2.4) |

За единицу количества информации принята величина информации, содержащейся в сообщении об одном из двух равновероятных событий.

До получения сообщения выполняются условия:

| P1 = P2 = | 1 | = | 1 |

| (2.5) |

| N | 2 |

При подстановке (2.5) в (1.13) получаем:

| H = (½ log2 ½ + ½ log2 ½) = + log2 2 = 1 bit |

Наименование «бит» (“bit”) происходит от сокращения английских слов «двоичная единица» (bi nary un it).

В реальных текстах появлению разных букв соответствуют разные вероятности. Так, например, для русских текстов вероятность появления буквы "О" в 30 раз превышает вероятность появления буквы «Щ» или «Э» (Ро= 0,09;

Рщ= Рэ= 0,003).

При подстановке в формулу (1.13) реальных значений вероятностей букв русского текста величина реальной информационной энтропии Н r уменьшается по сравнению с максимальной энтропией, определяемой выражением (2.4).

Разность между величиной максимальной энтропии Н max и реальной энтропии Н r соответствует количеству избыточной (предсказуемой) информации In.

Таким образом:

| In = Hmax – Hr | (2.6) |

Учет реальных значений вероятностей букв при передаче письменных текстов позволяет уменьшить избыточность сообщений, передаваемых по каналам связи. Так, например, для избавления от избыточности используется способ кодирования букв алфавита, при котором часто повторяющимся в тексте буквам

(т.е. буквам, имеющим наибольшую вероятность, такую, например, как Ра = =0,062; Рв = 0,038; Ре = 0,072; Рл = 0,035; Ро = 0,09 и др.) соответствуют или меньшая трата энергии за счет уменьшения величины (амплитуды) сигналов или, увеличенная скорость передачи за счет сокращения числа знаков двоичного кода, соответствующего обозначению указанных букв.

Помимо учета реальных вероятностей букв, для уменьшения избыточности сообщений следует учитывать также вероятности их сочетаний (например, высокую вероятность появления буквы Я после переданного сочетания ТЬС, малую вероятность появления согласной буквы после передачи следующих друг за другом трех согласных букв и т.п.).

|

|

Таблица 1

| Способ формирования «фраз» | №№ пп | "Фразы", полученные на основе статистических свойств русского языка | Статистические характеристики фраз | |

| Н r (бит) | D Is (бит) | |||

| При равной вероятности всех букв | 1 | СУХРРОБЬТ ЯИХВЩИЮАЙЖТЛ-ФВНЗАГФОЕВШТТЦРПХГРКУ -ЧЖОРЯПЧЬКЙХРЫС | 5,0 | 0,0 |

| При учете реальных вероятностей: | ||||

| отдельных букв 3-х - буквенных сочетаний | 2 | ЕЫНТ ЦИЯЬА СЕРВ ОДНГ ЬУЕМЛОЙК ЭБЯ ЕНВТША ПОКАК ПОТ ДУРНОСКАКА НАКОНЕПНО SHE СТВО - | 4,3 | 0,7 |

| 3 | ЛОВИЛ СЕ ТВОЙ ОБНИЛ Ь | 3,5 | 1.5 | |

| 4-х - буквенных сочетаний | 4 | ВЕСЕЛ ВРАТЬСЯ НЕ СУХОМ И НЕПО И КОРКО | 2,9 | 2,1 |

| 8-ми - буквенных сочетаний | 1,8 | 3.2 | ||

| Выборка из реального текста | 5 | ПРИСВОИВ ДВОИЧНЫЕ НОМЕРА БУКВАМ АЛФАВИТА, МОЖНО ПВРЕВРАТИТЬ ЛЮБОЙ ТЕКСТ В ЧЕРЕДОВАНИЕ ЕДИНИЦ И НУЛЕЙ | 1,0 | 4,0 |

| При РА = 1; РБ-Рв-.-.-Ря = О | АААА.. | 0,0 | 5,0 | |

В результате взаимной корреляции букв в употребляемых в текстах буквенных сочетаний происходит дополнительное уменьшение определяемой выражением (1.13) реальной энтропии Нr по сравнению с определяемой выражением (2.4) максимальной энтропии Нmax. Подстановка значения Нr, вычисленного с учетом взаимной корреляции букв, в выражение (2.6) дает дополнительное увеличение численного значения избыточной информации In (таблица 1). Указанные свойства письменных текстов наглядно иллюстрируются таблицей искусственных текстов, полученных путем случайных выборок из реальных текстов отдельных букв или их сочетаний. Вместе с тем, указанная таблица показывает, что вместе с увеличением избыточности увеличивается и упорядо ченность (детерминация) текста, достигая в пределе «жесткой детерминации», при которой текст вырождается в повторение одинаковых букв.

Такая взаимосвязь между избыточностью и упорядоченностью текста обусловлена тем, что избыточность текста обусловлена действием грамматических и фонетических правил. Именно этими правилами обусловлена присущая тексту структурность, следовательно, вычисляемое согласно (2.6) количество избыточной информации In является одновременно и количеством информации, сохраняемой в упорядоченой структуре текста или любых других структурированных систем:

| D IS = Hmax – Hr | (2.7) |

Для уяснения смысла равенства In = D IS, вытекающего из сопоставления выражений (2.6) и (2.7), рассмотрим следующий пример.

Некто получил сообщение, что из яйца вылупился птенец. Для подтверждения того, что это именно птенец, а не малек, сообщается, что у него не плавники, а крылья, не жабры, а легкие и т.п. Разумеется, все это не будет избыточной информацией In для всякого, кто знает, чем отличается птенец от малька.

Но та же самая информация о крыльях, легких, клюве и т.п., заложенная в генетический код, регулирует процесс онтогенеза, в результате которого в яйце формируется организм птенца, а не малька. Таким образом, информация In, избыточная для осведомленного получателя, оказывается необходимой структурной информацией D IS, когда речь идет об информационном управлении процессами формирования тех или иных упорядоченных структур. Вследствие этого и выполняется условие:

|

|

| In = D IS = Hmax – Hr | (2.8) |

|

|

|

Двойное оплодотворение у цветковых растений: Оплодотворение - это процесс слияния мужской и женской половых клеток с образованием зиготы...

Организация стока поверхностных вод: Наибольшее количество влаги на земном шаре испаряется с поверхности морей и океанов (88‰)...

История создания датчика движения: Первый прибор для обнаружения движения был изобретен немецким физиком Генрихом Герцем...

Механическое удерживание земляных масс: Механическое удерживание земляных масс на склоне обеспечивают контрфорсными сооружениями различных конструкций...

© cyberpedia.su 2017-2024 - Не является автором материалов. Исключительное право сохранено за автором текста.

Если вы не хотите, чтобы данный материал был у нас на сайте, перейдите по ссылке: Нарушение авторских прав. Мы поможем в написании вашей работы!