Правило коррекции по ошибке. Процесс обучения искусственной нейронной сети состоит в коррекции исходных значений весовых коэффициентов межнейронных связей, которые обычно задаются случайным образом. При вводе входных данных запоминаемого примера (стимула) появляется реакция, которая передается от одного слоя нейронов к другому, достигая последнего слоя, где вычисляется результат. Разность между известным значением результата и реакцией сети соответствует величине ошибки, которая может использоваться для корректировки весов межнейронных связей. Корректировка заключается в небольшом (обычно менее 1%) увеличении синаптического веса тех связей, которые усиливают правильные реакции, и уменьшения тех, которые способствуют ошибочным. Это простейшее правило контролируемого обучения (дельта-правило) используется в однослойных сетях с одним уровнем настраиваемых связей между множеством входов и множеством выходов. При этом на каждом k - шаге для j -го нейрона вес i - й связи вычисляется по формуле

где  известное (правильное) значение выхода j - нейрона;

известное (правильное) значение выхода j - нейрона;  рассчитанное значение выхода j - нейрона;

рассчитанное значение выхода j - нейрона;  величина сигнала на i - м входе, η - коэффициент скорости обучения.

величина сигнала на i - м входе, η - коэффициент скорости обучения.

Оптимальные значения весов межнейронных соединений можно определить путем минимизации среднеквадратичной ошибки с использованием детерминированных или псевдослучайных алгоритмов поиска экстремума в пространстве весовых коэффициентов. При этом возникает традиционная проблема оптимизации, связанная с попаданием в локальный минимум.

Правило Хебба. Оно базируется на следующем нейрофизиологическом наблюдении: если нейроны по обе стороны синапса активизируются одновременно и регулярно, то сила их синаптической связи возрастает. При этом изменение веса каждой межнейронной связи зависит только от активности нейронов, образующих синапс. Это существенно упрощает реализацию алгоритмов обучения.

Обучение методом соревнования. В отличие от правила Хебба, где множество выходных нейронов возбуждается одновременно, в данном случае выходные нейроны соревнуются (конкурируют) между собой за активизацию. В процессе соревновательного обучения осуществляется модификация весов связей выигравшего нейрона и нейронов, расположенных в его окрестности (''победитель забирает все»).

Метод обратного распространения ошибки. Он является обобщением процедуры обучения простого перцептрона с использованием дельта-правила на многослойные сети. В данном методе необходимо располагать обучающей выборкой, содержащей «правильные ответы», т.е. выборка должна включать множество пар образцов входных и выходных даны, между которыми нужно установить соответствие. Перед началом обучения межнейронным связям присваиваются небольшие случайные значения. Каждый шаг обучающей процедуры состоит из двух фаз. Во время первой фазы входные элементы сети устанавливаются в заданное состояние. Входные сигналы распространяются по сети, порождая некоторый выходной вектор. Для работы алгоритма требуется, чтобы характеристика вход-выход нейроподобных элементов была неубывающей и имела ограниченную производную. Обычно для этого используют сигмоидальные функции. Полученный выходной вектор сравнивается с требуемым (правильным). Если они совпадают, то весовые коэффициенты связей не изменяются. В противном случае вычисляется разница между фактическими и требуемыми выходными значениями, которая передается последовательно от выходного слоя к входному. На основе этой информации проводится модификация связей в соответствии с обобщенным дельта-правилом, которое имеет вид:  , где изменение в силе связи

, где изменение в силе связи  для p - й обучающей пары

для p - й обучающей пары  пропорционально произведению сигнала ошибки j - го нейрона

пропорционально произведению сигнала ошибки j - го нейрона  получающего входной сигнал по этой связи, и выходного сигнала i - го нейрона

получающего входной сигнал по этой связи, и выходного сигнала i - го нейрона  посылающего сигнал по этой связи. Определение сигнала ошибки является рекурсивным процессом, который начинается с выходных блоков. Для выходного блока сигнал ошибки

посылающего сигнал по этой связи. Определение сигнала ошибки является рекурсивным процессом, который начинается с выходных блоков. Для выходного блока сигнал ошибки

где  и

и  соответственно желаемое и действительное значения выходного сигнала j - го блока;

соответственно желаемое и действительное значения выходного сигнала j - го блока;  производная от выходного сигнала j - го блока. Сигнал ошибки для скрытого блока определяется рекурсивно через сигнал ошибки блоков, с которым соединен его выход, и веса этих связей равны

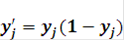

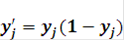

производная от выходного сигнала j - го блока. Сигнал ошибки для скрытого блока определяется рекурсивно через сигнал ошибки блоков, с которым соединен его выход, и веса этих связей равны  . Для сигмоидальной функции

. Для сигмоидальной функции  поэтому на интервале 0

поэтому на интервале 0  1 производная имеет максимальное значение в точке

1 производная имеет максимальное значение в точке  =0,5, а в точках

=0,5, а в точках  =0 и

=0 и  =1 обращает в ноль. Максимальные изменения весов соответствуют блокам (нейронам), которые еще не выбрали свое состояние. Кроме того, при конечных значениях весовых коэффициентов выходные сигналы блоков не могут достигать значений 0 или 1. Поэтому за 0 обычно принимают значения

=1 обращает в ноль. Максимальные изменения весов соответствуют блокам (нейронам), которые еще не выбрали свое состояние. Кроме того, при конечных значениях весовых коэффициентов выходные сигналы блоков не могут достигать значений 0 или 1. Поэтому за 0 обычно принимают значения  <0,1, а за 1 - значения

<0,1, а за 1 - значения  >0,9.

>0,9.

Модификация весов производится после предъявления каждой пары вход-выход. Однако если коэффициент  , определяющий скорость обучения, мал, то можно показать, что обобщенное дельта-правило достаточно хорошо аппроксимирует минимизацию общей ошибки функционирования сети D методом градиентного спуска в пространстве весов. Общая ошибка функционирования сети определяется по формуле

, определяющий скорость обучения, мал, то можно показать, что обобщенное дельта-правило достаточно хорошо аппроксимирует минимизацию общей ошибки функционирования сети D методом градиентного спуска в пространстве весов. Общая ошибка функционирования сети определяется по формуле

D =  .

.

Обучение продолжается до тех пор, пока ошибка не уменьшиться до заданной величины. Эмпирические результаты свидетельствуют о том, что при малых значениях η система находит достаточно хороший минимум D. Однако из основных недостатков алгоритмов обратного распространения ошибки заключается в том, что во многих случаях для сходимости может потребоваться многократное (сотни раз) предъявление всей обучающей выборки. Повышения скорости обучения можно добиться, например, используя информацию о второй производной D или путем увеличения η.

Алгоритм обратного распространения ошибки используется также для обучения сетей с обратными связями. При этом используется эквивалентность многослойной сети с прямыми связями и синхронной сети с обратными связями на ограниченном интервале времени (слой соответствует такту времени).

известное (правильное) значение выхода j - нейрона;

известное (правильное) значение выхода j - нейрона;  рассчитанное значение выхода j - нейрона;

рассчитанное значение выхода j - нейрона;  величина сигнала на i - м входе, η - коэффициент скорости обучения.

величина сигнала на i - м входе, η - коэффициент скорости обучения. , где изменение в силе связи

, где изменение в силе связи  для p - й обучающей пары

для p - й обучающей пары  пропорционально произведению сигнала ошибки j - го нейрона

пропорционально произведению сигнала ошибки j - го нейрона  получающего входной сигнал по этой связи, и выходного сигнала i - го нейрона

получающего входной сигнал по этой связи, и выходного сигнала i - го нейрона  посылающего сигнал по этой связи. Определение сигнала ошибки является рекурсивным процессом, который начинается с выходных блоков. Для выходного блока сигнал ошибки

посылающего сигнал по этой связи. Определение сигнала ошибки является рекурсивным процессом, который начинается с выходных блоков. Для выходного блока сигнал ошибки

и

и  соответственно желаемое и действительное значения выходного сигнала j - го блока;

соответственно желаемое и действительное значения выходного сигнала j - го блока;  производная от выходного сигнала j - го блока. Сигнал ошибки для скрытого блока определяется рекурсивно через сигнал ошибки блоков, с которым соединен его выход, и веса этих связей равны

производная от выходного сигнала j - го блока. Сигнал ошибки для скрытого блока определяется рекурсивно через сигнал ошибки блоков, с которым соединен его выход, и веса этих связей равны  . Для сигмоидальной функции

. Для сигмоидальной функции  поэтому на интервале 0

поэтому на интервале 0  1 производная имеет максимальное значение в точке

1 производная имеет максимальное значение в точке  =0,5, а в точках

=0,5, а в точках  =0 и

=0 и  , определяющий скорость обучения, мал, то можно показать, что обобщенное дельта-правило достаточно хорошо аппроксимирует минимизацию общей ошибки функционирования сети D методом градиентного спуска в пространстве весов. Общая ошибка функционирования сети определяется по формуле

, определяющий скорость обучения, мал, то можно показать, что обобщенное дельта-правило достаточно хорошо аппроксимирует минимизацию общей ошибки функционирования сети D методом градиентного спуска в пространстве весов. Общая ошибка функционирования сети определяется по формуле .

.