ОСНОВНЫЕ ПОДХОДЫ В ОПРЕДЕЛЕНИИ ПОНЯТИЯ ИНФОРМАЦИИ (ХАРАКТЕРИСТИКА ИНФОРМАЦИИ КАК УСТРАНЁННОЙ НЕОПРЕДЕЛЁННОСТИ, СНЯТОЙ НЕРАЗЛИЧИМОСТИ, ОТРАЖЁННОГО РАЗНООБРАЗИЯ)

ОСНОВНЫЕ ПОДХОДЫ В ОПРЕДЕЛЕНИИ ПОНЯТИЯ ИНФОРМАЦИИ. ИСТОРИЯ СТАНОВЛЕНИЯ ПОНЯТИЯ ИНФОРМАЦИЯ

«Информация» от лат. — разъяснение, изложение, осведомленность. Сначала под этим словом понимали «представление», «понятие», затем — «сведения», «передачу сообщений». В XX в. бурное развитие получили средства связи (телефон, телеграф, радио), назначение которых заключалось в передаче сообщений. Требовалась разработка теории передачи сообщений, или теории информации. Основным стал вопрос о возможности измерения количества информации.

Попытки количественного измерения информации предпринимались неоднократно. Р.Фишером (1921) в процессе решения вопросов математической статистики. Проблемами хранения информации, передачи ее по каналам связи и задачами определения количества информации занимались Р.Хартли (1928) и Х.Найквист (1924). Хартли заложил основы теории информации, определив меру количества информации для некоторых задач. Наиболее убедительно эти вопросы были разработаны и обобщены американским инженером Клодом Шенноном в 1948. Тогда началось интенсивное развитие теории информацию

Основные подходы: - связанные с количественным аспектом понятия информации без учета смысловой стороны информации. В результате которых

были созданы кибернетические устройства, вычислительные машины и пр. Все это стало возможным благодаря достижениям теории информации. Для того чтобы применить математические средства для изучения информации, потребовалось отвлечься от смысла, содержания информации. Отправной точкой для информационной оценки события остается - множество отличных друг от друга событий и соответственно сообщений о них. Теория информации основана на вероятностных, статистических закономерностях явлений. В «структурно-синтаксическую» сторону ее передачи, т. е. выражают отношения сигналов.

- Попытки оценить содержательную сторону информации дали толчок к развитию семантической (смысловой) теории информации. Семиотика —

теорией знаковых систем.

ХАРАКТЕРИСТИКА АЛГОРИТМІЧЕСКОГО ПОДХОДЯ К ОПРЕДЕЛЕНИЯ ПОНЯТИЯ ИФОРМАЦИИ

Очень близка к «разнообразностной» трактовке информации идея алгоритмического измерения ее количества, выдвинутая в 1965 г. А. Н. Колмогоровым. СУТЬ - количество информации определяется как минимальная длина программы, позволяющей преобразовать один объект (множество) в другой (множество). Чем больше различаются два объекта между собой, тем сложнее (длиннее) программа перехода от одного объекта к другому. Так, воспроизвести последовательность букв а, а, а можно при помощи очень простой программы. Несколько большей окажется длина программы, восстанавливающей последовательность а, в, с, а, в, с,... Длина программы при этом измеряется количеством команд (операций), позволяющих воспроизвести последовательность. Этот подход, в отличие от подхода Шеннона, не базирующийся на понятии вероятности, позволяет, например, определить прирост количества информации, содержащейся в результатах расчета, по сравнению с исходными данными. Вероятностная теория информации на этот вопрос не может дать удовлетворительного ответа.

ХАРАКТЕРИСТИКА ИНФОРМАЦИИ КАК ОТРАЖЁННОГО РАЗНООБРАЗИЯ

Рассмотрим понятие информации как отраженного разнообразия. Источником разнообразия, по мнению В. М. Глушкова, является неоднородность распределения материи и энергии в пространстве и во времени. Отсюда и определение, данное В. М. Глушковым: информация — это мера неоднородности распределения материи и энергии в пространстве и во времени, показатель изменений, которыми сопровождаются все происходящие в мире процессы. Если теперь перейти к более общему определению, то можно считать информацию свойством материи.

КОЛИЧЕСТВО ИНФОРМАЦИИ, ЕЕ ОПРЕДЕЛЕНИЕ. ЕДИНИЦА ИНФОРМАЦИИ. ПОНЯТИЕ ЭНТРОПИИ В ТЕОРИИ ИНФОРМАЦИИ.

ПОНЯТИЕ ТЕЗАУРУСА.

Все здание человеческого знания, согласно этой модели, можно рассматривать в виде совокупности смысловыражающих элементов и смысловых отношений между ними. Множество смысловыражающих элементов и смысловых отношений на нем называется тезаурусом. Слово «тезаурус» происходит от греческого — сокровище, сокровищница, все огромное множество понятий и отношений между ними, иными словами, тезаурус составляет главное сокровище человека — его знания. Таким образом, ТЕЗАУРУС — это знание, представленное в виде понятий и отношений между ними, т. е. определенным образом структурированное знание.

В широком смысле Тезаурус интерпретируют как описание системы знаний о действительности, которыми располагает индивидуальный носитель информации или группа носителей. Этот носитель может выполнять функции приёмника дополнительной информации, вследствие чего изменяется и его Тезаурус. Исходный тезаурус определяет при этом возможность приёмника при получении им семантической информации. Тезаурус фактически содержит не только информацию о действительности, но и метаинформацию (сведения об информации), обеспечивающую возможность приёма новых сообщений.

1) 2) 3)

Возможным способом измерения эффективности коммуникации является степень изменения тезауруса реципиента при получении некоторого сообщения.

Итак, количество семантической информации может определяться долей "новых" для реципиента элементов тезауруса сообщения,

Как известно, в классической теории информации понятие информации связано со снятием неопределенности, которая существовала до сообщения.

4. ТИПОЛОГИЯ, ОБЩИЕ СВОЙСТВА ИНФОРМАЦИИ И ЗАКОНОМЕРНОСТИ РАСПРОСТРАНЕНИЯ ИНФОРМАЦИИ, В ЧАСТНОСТИ НАУЧНОЙ

ЗАКОН ЦИПФА

Несколько смягчить создавшееся положение в постоянно увеличивающемся потоке документов поможет закон Ципфа. В конце 40-х годов нашего столетия Дж.Ципф, собрав огромный статистический материал, попытался показать, что распределение слов естественного языка подчиняется одному простому закону, который можно сформулировать следующим образом. Если к какому-либо достаточно большому тексту составить список всех встретившихся в нем слов, затем расположить эти слова в порядке убывания частоты их встречаемости в данном тексте и пронумеровать в порядке от 1 (порядковый номер наиболее часто встречающегося слова) до Я, то для любого слова произведение его порядкового номера (ранга) г в таком списке и частоты его встречаемости в тексте будет величиной постоянной, имеющей примерно одинаковое значение для любого слова из этого списка. Аналитически закон Ципфа может быть выражен в виде: fr = c, где f - частота встречаемости слова в тексте; r - ранг (порядковый номер) слова в списке; с - эмпирическая постоянная величина. Полученная зависимость графически выражается гиперболой. Исследовав, таким образом, самые разнообразные тексты и языки, в том числе языки тысячелетней давности, Дж.Ципф для каждого из них построил указанные зависимости, при этом все кривые I имели одинаковую форму — форму «гиперболической лестницы», т. е. при замене одного текста другим общий характер распределения не изменялся.

ЗАКОН БРЕДФОРДА

Частным случаем вышеупомянутого закона является закон Бредфорда, непосредственно связанный с распределением документов внутри какой-либо тематической области.

Английский химик и библиограф С.Брэдфорд, исследуя статьи по прикладной геофизике и смазке, заметил, что распределения научных журналов, содержащих статьи по смазке, и журналов, содержащих статьи по прикладной геофизике, имеют общий вид. На основании установленного факта С. Брэдфорд сформулировал закономерность распределения публикаций по изданиям

Основной смысл закономерности состоит в следующем: если научные журналы расположить в порядке убывания числа статей по конкретному вопросу, то журналы в полученном списке можно разбить на три зоны таким образом, чтобы количество статей в каждой зоне по заданному предмету было одинаковым. При этом в первую зону, так называемую зону ядра, входят профильные журналы, непосредственно посвященные рассматриваемой тематике. Количество профильных журналов в зоне ядра невелико. Вторую зону образуют журналы, частично посвященные заданной области, причем число их существенно возрастает по сравнению с числом журналов в ядре. Третья зона, самая большая по количеству изданий, объединяет журналы, тематика которых весьма далека от рассматриваемого предмета.

Таким образом, при равном числе публикаций по определенной тематике в каждой зоне число наименований журналов резко возрастает при переходе от одной зоны к другой. С.Брэдфорд установил, что количество журналов в третьей зоне будет примерно во столько раз больше, чем во второй зоне, во сколько раз число наименований во второй зоне больше, чем в первой, и обозначим Р 1 — число журналов в 1-й зоне, Р2 во 2-й, Р3 —число журналов в 3-й зоне.

Если а — отношение количества журналов 2-й зоны к числу журналов 1-й зоны, то закономерность, вскрытая С. Брэдфордом, может быть записана так: Р1: Р2: Р3 = 1: а: а2 или Р3/Р2 = Р2/ Р1 = a. Эту зависимость называют законом Брэдфорда. Б.Викери уточнил модель С.Брэдфорда. Он выяснил, что журналы, проранжированные (выстроенные) в порядке уменьшения в них статей по конкретному вопросу, можно разбить не на три зоны, а на любое нужное число зон. Если периодические издания расположить в порядке уменьшения в них количества статей по конкретному вопросу, то в полученном списке можно выделить ряд зон, каждая из которых содержит одинаковое количество статей. Примем следующие обозначения: х — количество статей в каждой зоне, Тх — количество журналов, содержащих х статей; Т2х — количество журналов, содержащих 2х статей, т. е. сумма наименований журналов в 1-й и во 2-й зонах; Т3х — количество журналов, содержащих Зх статей, т. е. сумма наименований журналов в 1-й, 2-й и в 3-й зонах; Т4х — количество журналов, содержащих 4х статей. Тогда эта закономерность будет иметь вид Тх: Т2х: Т3х: Т4х:... = 1: а:а2: а3:...

данное выражение называют законом Брэдфорда в толковании Б.Викери.

Если закон Ципфа характеризует многие явления социального и биологического характера, то закон Брэдфорда — это специфический случай распределения Ципфа для системы периодических изданий по науке и технике. Из этих закономерностей можно извлечь выводы огромной практической пользы. Так, если расположить какие-либо периодические издания в порядке убывания количества статей по определенному профилю, то, согласно Брэдфорду, их можно разбить на три группы, содержащие равное количество статей.

РАНГОВОЕ РАСПРЕДЕЛЕНИЕ

Упорядоченность задается ранжированием (порядком размещения) наименований элементов по частоте их появления в порядке ее убывания. Такая упорядоченная совокупность наименований элементов называется ранговым распределением. Распределения, которые в свое время изучал Ципф,— это типичные примеры ранговых распределений. Оказалось, что вид рангового распределения, его строение характеризуют ту совокупность документов, к которой относится данное ранговое распределение. Выяснилось, что при построении ранговые распределения в большинстве случаев имеют форму закономерности Ципфа с поправкой Мандельброта: fr γ = c.

При этом коэффициент γ - величина переменная. Постоянство коэффициента γ сохраняется только на среднем участке графика распределения. Этот участок принимает форму прямой, если график вышеприведенной закономерности построить в логарифмических координатах. Участок распределения с γ = const называется центральной зоной рангового распределения (значение аргумента на этом участке изменяется от ln r 1 до ln r 2). Значениям аргумента от 0 до ln r 1, соответствует зона ядра рангового распределения, а значениям аргумента от ln r 2 до ln r 3 - так называемая зона усечения.

При этом коэффициент γ - величина переменная. Постоянство коэффициента γ сохраняется только на среднем участке графика распределения. Этот участок принимает форму прямой, если график вышеприведенной закономерности построить в логарифмических координатах. Участок распределения с γ = const называется центральной зоной рангового распределения (значение аргумента на этом участке изменяется от ln r 1 до ln r 2). Значениям аргумента от 0 до ln r 1, соответствует зона ядра рангового распределения, а значениям аргумента от ln r 2 до ln r 3 - так называемая зона усечения.

Какой же смысл заложен в существовании трех явно различаемых зон ранговых распределений? Если последнее относится к терминам, составляющим какую-либо область знаний, то ядерная зона, или зона ядра рангового распределения, содержит наиболее общеупотребительные, общенаучные термины. Центральная зона содержит термины, наиболее характерные для данной области знаний, которые в совокупности выражают ее специфичность, отличие от других наук, «охватывают ее основное содержание». В зоне усечения же сосредоточены термины, сравнительно редко употребляющиеся в данной области знаний.

Таким образом, основа лексики какой-либо области знаний сосредоточена в центральной зоне рангового распределения.

Так, на основании анализа рангового распределения оказалось возможным дать качественные оценки документальным информационным потокам в соответствии с теми отраслями, науки, где они формировались.

КЛАССИФИКАЦИЯ СИСТЕМ

Системы могут быть проклассифицированы в зависимости от их природы, тогда могут различаться механические, гидравлические, космические, химические и многие другие классы систем, однако существует основание классификации, которое наиболее существенно для правоведения, именно деление всех систем на простые и сложные (с рядом промежуточных классов).

Важнейшей особенностью систем как кибернетических объектов является информационная природа тех объединительных связей, которые и позволяют воспринимать систему как единый целостный объект.

" Без регулярно осуществляемой информационной связи невозможно функционирование самоуправляемой системы и сохранение ее целостности. Ослабление или полная потеря информационной связи элементов самоуправляемой системы неизбежно приводит к разрушению всех других связей, к прекращению физических и других взаимодействий в рамках системы как целостного образования, к распаду системы"

Системы можно классифицировать по обусловленности их действия и степени сложности: Детерминированной системой принято называть такую систему, у которой составляющие ее элементы и связи между ними взаимодействуют так, что если известны начальное состояние системы и программа перехода ее в другое состояние, то всегда можно точно описать, каким будет это новое состояние системы. Случайной (вероятностной, стохастической) системой называют такую систему, у которой составляющие ее элементы и связи между ними взаимодействуют таким образом, что нельзя сделать точного, детального предсказания ее поведения, утверждать о последовательности состояний. Такая система всегда остается неопределенной, и предсказание о ее будущем поведении никогда не выходит из рамок вероятностных категорий, с помощью которых это поведение описывается.

По степени сложности системы подразделяются на простые и сложные. Простая система не имеет разветвленной структуры, содержит небольшое число взаимодействующих элементов и выполняет простейшие функции. Важное место в теории систем

занимает выяснение того, что есть сложная система и чем она отличается от просто системы с большим числом элементов (такие системы можно назвать громоздкими).

Сложная система - это система имеющая разветвленную структуру и значительное количество взаимосвязанных и взаимодействующих элементов, выполняющих более сложные функции. Противопоставление сложных систем просто кибернетическим системам можно сформулировать так: Сложная система имеет семиотическую (т.е. полноценно языковую) природу информационных связей между подсистемами в противовес простым системам, где имеется функциональная сигнализация... В сложной системе обмен информацией происходит на семантическом уровне в противовес простым системам, где все информ. связи осуществляются на синтаксическом уровне.

Системы классифицируются по характеру связей параметров системы с окружающей средой.

- закрытые системы — какой-либо обмен энергией, веществом и информацией с окружающей средой отсутствует. Для закрытых систем характерно увеличение беспорядка (второй закон термодинамики).

- замкнутые системы — обмениваются только энергией, но не обмениваются веществом; изолированные системы — любой обмен исключен.

Открытые системы — свободно обменивающиеся энергией, веществом и информацией с окружающей средой. В открытых системах могут происходить явления самоорганизации, усложнения или спонтанного возникновения порядка.

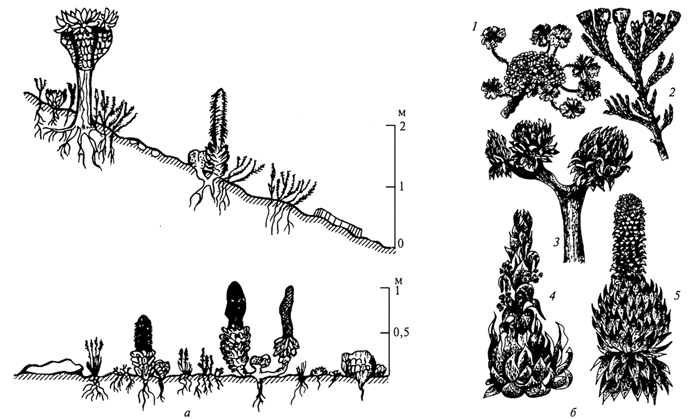

Классификации систем по происхождению (природной принадлежности): естественные (природные)- неорганические; биологические; экологические; другие.

Искусственные -материальные; абстрактные (идеальные); абстрактно - материальные; Смешанные - социо-технологические; организациоино-технические;социально-экономические.

7. ПОНЯТИЕ И ОПРЕДЕЛЕНИЕ НЕЧЕТКИХ МНОЖЕСТВ, СТЕПЕНИ И ФУНКЦИИ ПРИНАДЛЕЖНОСТИ В ТЕОРИИ НЕЧЕТКИХ МНОЖЕСТВ. ИСПОЛЬЗОВАНИЕ ТЕОРИИ НЕЧЕТКИХ МНОЖЕСТВ.

КИБЕРНЕТИКА

В1974 году Айзек Азимов, амер. ученый, писал «Я никогда в действительности не предполагал, что искусственный интеллект возможен, и я совершенно определенно не предполагал, что застану время, когда люди будут серьезно работать в этой области". следует отметить заслуги амер. ученого Норберта Винера, который и ввел в употребление слово "кибернетика", которое в переводе с греч. означает «искусство кормчего». Основополагающее значение имела его книга "Кибернетика или управление и связь в животных и машинах" (1948год). Винер положил в основу кибернетики изучение законов передачи и переработки информации. Сущность принципа управления заключается в том, что движение и действие больших масс или передача и преобразование больших количеств энергии направляются и контролируются при помощи небольших количеств энергии, несущих информацию. Этот принцип управления лежит в основе организации и действия любых управляемых систем: автоматических машин и живых организмов.

Сегодня кибернетика - полноправная наука, наука об управлении различных областях человеческой деятельности, живого мира и техники. В ее становлении и развитии выдающаяся роль принадлежит ученым-академикам Акселю Ивановичу Бергу (1893-1979), Виктору Михайловичу Глушкову (1823-1982).

Предмет и методы кибернетики. Основным методом кибернетики считается метод алгоритмического описания функционирования управляющих систем, а математическая сторона кибернетики - это изучение управляющих алгоритмов, т.е. алгоритмов описывающих те или иные управляющие системы. Кроме математических, в кибернетике значительную роль играют так называемые "экспериментальные" методы исследования: наблюдение, статистический анализ, «логический анализ и моделирование, машинный эксперимент». Основными классами кибернетических задач являются:

- Создание эффективной теории (сопровождающееся или не сопровождающееся) разработкой реальных устройств, воспроизводящих составные модели, позволяющей имитировать различные аспекты поведения человека и других Форм поведения организмов или обеспечивающей создание искусственного интеллекта.

- Создание моделей теорий поведения человека и других форм поведения организмов. В этих моделях функции, присущие человеческим существам или иным системам, реализуются точно таким же образом, как они осуществляются человеком или другими системами. Это задача моделирования или имитации.

- воспроизведение, или моделирование поведения человека или животного в целом с помощью моделей "конструкции" человеческого существа или животного.

Кибернетика представляет собой научный синтез целого ряда относительно отдаленных друг от друга специальных дисциплин,

Кибернетика, изучающая процессы и закономерности связи и управления, распространяет их на весьма широкую сферу объективной реальности, включая биологическую, социальную и частично более низкие формы движения материи и несет тем самым мощный интегративный заряд.

Она распадается на десятки направлений - математическая кибернетика, техническая кибернетика, биологическая кибернетика, медицинская кибернетика, экономическая и даже - юридическая кибернетика, иногда уходит и самое первое название науки - мы все чаще слышим об информатике

ИНФОРМАТИКА

Informatik - это немецкое название для Computer science (компьютерная наука) - области знаний, которая сложилась в самостоятельную научную дисциплину в шестидесятые годы, прежде всего в США, а также Великобритании. Информатика - это наука, изучающая фундаментальные свойства, структуру, функции автоматизированных информационных систем, а также основы их проектирования, создания, оценки, использования и воздействие на различные области социальной практики.

Информатика - это наука о законах и методах получения, накопления, хранения, переработки и передачи информации с использованием ЭВМ. С появлением ЭВМ - универсальных автоматических устройств - стало возможным решать любые задачи по переработке информации. С ЭВМ, а значит, с рождением и распространением новой автоматической технологии сбора, обработки, хранения и передачи информации связано появление новой научной дисциплины - информатики.

Предметом информатики выступают во взаимодействии со средой машино-информационные системы, воплощающие в себе новую, неизвестную в прошлом, технологию сбора, переработки, передачи информации. Программирование - дисциплина, которая исследует методы формулирования и решения задач с помощью ЭВМ; это важнейшая, определяющая составная часть информатики. Информатика активно преобразует другие технологии материального и нематериального производств и в конечном счете формирует новый стиль работы и новый уклад жизни.

Информатика дифференцируется в зависимости от конкретных областей применения - экономики, политики, военного дела, науки. Она дифференцируется также в зависимости от уровня развития технических систем, отличаясь разными техническими средствами, носителями ин формации, способами взаимодействия машин с людьми. Например, информатика, базирующаяся на втором поколении ЭВМ, принципиально отличается от информатики, базирующейся на четвертом поколении ЭВМ. Можно вести речь об общей информатике и ее более конкретных (прикладных) ответвлениях: экономической информатике, политической, научной, военной информатике, правовой.

ОСНОВНЫЕ ПОНЯТИЯ ИНФОРМАТИКИ И КИБЕРНЕТИКИ.

ПОНЯТИЯ ИНФОРМАТИКИ

Информация - это совокупность сведений (данных), которая воспринимается из окружающей среды (входная информация), выдается в окружающую среду (исходная информация) или сохраняется внутри определенной системы.

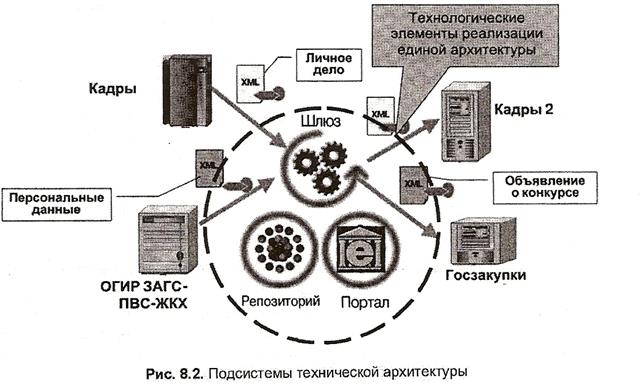

Информационная система - взаимосвязанная совокупность средств, методов и персонала, используемая для сохранения, обработки и выдачи информации с целью решения конкретной задачи.

Информационная технология (определение Глушкова В.М.), человеко-машинную технологию сбора, обработки и передачиинформации, которая базируется на использовании вычислительной техники.

Информационные ресурсы — различные формализованные знания (теории, идеи, изобретения), данные (в том числе документы), технологии и средства их сбора, обработки, анализа, интерпретации и применения, а также обмена между источниками и потребителями информации.

Информационный процесс — Последовательность действий (операций) по сбору, передаче, обработке, анализу, выделению и использованию с различной целью информации (и/или её носителей) в ходе функционирования и взаимодействия материальных объектов.

ПОНЯТИЯ КИБЕРНЕТИКИ

Управление - функция организованных систем различной природы, обеспечивающая сохранение их определённой структуры, поддержание режима деятельности, реализацию программы, цели деятельности.

Управление системой - это воздействие на объект, выбранное на основании имеющейся для этого информации из множества возможных воздействий, улучшающее его функционирование или развитие.

Система — совокупность элементов, образующих определенную структуру, которая функционирует для достижения какой-либо цели.

Сложная система - это система, имеющая разветвленную структуру и значительное количество взаимосвязанных и взаимодействующих элементов, выполняющих более сложные функции.

Тезаурус (от греч. сокровище, сокровищница) — это знание, представленное в виде понятий и отношений между ними, т. е. определенным образом структурированное знание.

Алгоритм — это набор элементарных операций, или строгая и четкая последовательность действий, выполнение которых (человеком или машиной) приводит к определенному результату.

ТОИС

- Основные подходы в определении понятия информации (характеристика информации как устранённой неопределённости, снятой неразличимости, отражённого разнообразия)

- Количество информации, ее определение. Единица информации. понятие энтропии в теории информации.

- Семантическая концепция информации. Понятие тезауруса. Закономерности восприятия информации реципиентом в рамках тезаурусной модели коммуникации.

- Типология, общие свойства информации и закономерности распространения информации, в частности научной

- Барьеры в информационном взаимодействии. Общие понятие виды.

- Понятие системы. Системные принципы. классификация систем

- Понятие и определение нечетких множеств, степени и функции принадлежности в теории нечетких множеств. использование теории нечетких множеств.

- Понятие информационной потребности. объективные и субъективные аспекты информационных потребностей. понятие релевантности и пертинентности в теории информационных систем.

- Специфика информационных потребностей ученых, специалистов, инженеров менеджеров и способы их изучения.

- Информатика и кибернетика как области знаний и деятельности. общие и специфические черты. Основные понятия информатики и кибернетики.

ОСНОВНЫЕ ПОДХОДЫ В ОПРЕДЕЛЕНИИ ПОНЯТИЯ ИНФОРМАЦИИ (ХАРАКТЕРИСТИКА ИНФОРМАЦИИ КАК УСТРАНЁННОЙ НЕОПРЕДЕЛЁННОСТИ, СНЯТОЙ НЕРАЗЛИЧИМОСТИ, ОТРАЖЁННОГО РАЗНООБРАЗИЯ)

При этом коэффициент γ - величина переменная. Постоянство коэффициента γ сохраняется только на среднем участке графика распределения. Этот участок принимает форму прямой, если график вышеприведенной закономерности построить в логарифмических координатах. Участок распределения с γ = const называется центральной зоной рангового распределения (значение аргумента на этом участке изменяется от ln r 1 до ln r 2). Значениям аргумента от 0 до ln r 1, соответствует зона ядра рангового распределения, а значениям аргумента от ln r 2 до ln r 3 - так называемая зона усечения.

При этом коэффициент γ - величина переменная. Постоянство коэффициента γ сохраняется только на среднем участке графика распределения. Этот участок принимает форму прямой, если график вышеприведенной закономерности построить в логарифмических координатах. Участок распределения с γ = const называется центральной зоной рангового распределения (значение аргумента на этом участке изменяется от ln r 1 до ln r 2). Значениям аргумента от 0 до ln r 1, соответствует зона ядра рангового распределения, а значениям аргумента от ln r 2 до ln r 3 - так называемая зона усечения.