Типы оградительных сооружений в морском порту: По расположению оградительных сооружений в плане различают волноломы, обе оконечности...

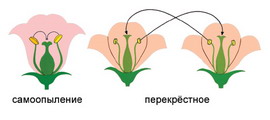

Семя – орган полового размножения и расселения растений: наружи у семян имеется плотный покров – кожура...

Типы оградительных сооружений в морском порту: По расположению оградительных сооружений в плане различают волноломы, обе оконечности...

Семя – орган полового размножения и расселения растений: наружи у семян имеется плотный покров – кожура...

Топ:

Генеалогическое древо Султанов Османской империи: Османские правители, вначале, будучи еще бейлербеями Анатолии, женились на дочерях византийских императоров...

Комплексной системы оценки состояния охраны труда на производственном объекте (КСОТ-П): Цели и задачи Комплексной системы оценки состояния охраны труда и определению факторов рисков по охране труда...

Устройство и оснащение процедурного кабинета: Решающая роль в обеспечении правильного лечения пациентов отводится процедурной медсестре...

Интересное:

Как мы говорим и как мы слушаем: общение можно сравнить с огромным зонтиком, под которым скрыто все...

Искусственное повышение поверхности территории: Варианты искусственного повышения поверхности территории необходимо выбирать на основе анализа следующих характеристик защищаемой территории...

Аура как энергетическое поле: многослойную ауру человека можно представить себе подобным...

Дисциплины:

|

из

5.00

|

Заказать работу |

|

|

|

|

Ожидать подобного безобразия в мире компьютеров не приходится, в их случае «железо» и «программный продукт» – это разные вещи. Само это железо может стать совершенно иным, работающим на других физических принципах, но с программным продуктом ничего не произойдёт – такова его природа.

«Мозг абсолютно не похож на компьютеры, которые могут поддерживать любые операционные системы и запускать любые типы программ. Если говорить в компьютерных терминах, “софт ” нашего мозга – то, как мозг работает, – плотно связан с его структурой – его “железом ”. Если мы хотим понять, на что способен этот “софт”, мы должны понять, как устроены и связаны друг с другом разные части мозга».

ДЭВИД ВАН ЭССЕН, Вашингтонский университет в Сент-Луисе

Более того, если разные программные продукты говорят на одном языке, то вообще проблем нет, а если они говорят на разных, то сделают «переходник-переводчик» или придумают новый, общий для них язык, и снова – никаких проблем. В конце концов, это всегда и только язык бинарного кода.

Иными словами, вся информация, доступная разным «центрам» огромной компьютерной сети, транспарентна. То есть они не только могут ею обмениваться без искажений, но и «понимают» её ровно так, как следует, – не передергивая, не выкручивая, не подтасовывая.

Нам же – людям – ничего подобного даже не снилось! Благодаря нашим хвалёным «квалиа» мы вообще ничего не способны понять одинаково[10]. Даже просто воспринимая один и тот же предмет, мы видим его по-разному. Так что искажения в нашем «информационном поле» повсеместны и абсолютно неизбежны, а машинам – хоть бы хны.

КТО НАСТОЯЩЕЕ «СОЦИАЛЬНОЕ ЖИВОТНОЕ»?

Кому-то покажется, что в этот заголовок вынесен вопрос частного характера, но не будем спешить с выводами…

|

|

Да, с лёгкой руки Аристотеля мы именуем себя «социальными животными» и любим рассуждать в этих загадочных категориях – народ, научная элита, профессиональное сообщество и т. д.

Но давайте снимем розовые очки самолюбования и посмотрим правде в глаза: мы просто кладезь предельно ущербных коммуникативных навыков.

При этом, всего, что мы способны сделать, произвести ценного или хотя бы просто сносного, мы достигаем лишь благодаря взаимодействию с другими людьми, перенимая от них знания, опыт, обнаруживая свои ошибки в дискуссиях с ними и т. д.

Многого бы вы достигли, не будь вокруг вас ваших родителей, воспитателей, учителей, коллег и наставников? Думаю, нет. Исаак Ньютон – и тот «стоял на плечах гигантов», что уж говорить о нас, грешных…

То есть взаимодействие с другими людьми необходимо нам для нашей интеллектуальной деятельности. Однако же не мне вам рассказывать, насколько сложно нам даётся это взаимодействие, – постоянное непонимание, напряжение, упрямство, самодовольство и наслаивающиеся друг на друга когнитивные искажения.

Если вы трезво оцените любой спор – хоть кухонный, хоть философский, хоть сугубо академический, – то обнаружите, что действительным предметом спора в подавляющем большинстве случаев является вовсе не истина (как, видимо, предполагается), а правота: каждый оппонент хочет от другого лишь преклонённого колена и согласия с его точкой зрения.

Наши социальные взаимодействия, а точнее говоря – социальные игры, – это настоящий бич любой хоть сколько-нибудь здравой интеллектуальной инициативы: будь это политика, экономика, управление, культура или, к сожалению, даже наука (я уж молчу о различных видах творчества и тому подобных «субъективных» вещах).

Казалось бы, там, где дело касается точных наук или, например, программирования, такого точно не должно происходить. Но человек везде и всегда найдёт повод увязнуть в социальных играх.

|

|

Чего стоит знаменитый спор того же Ньютона с Лейбницем по поводу приоритета их исчислений, или противостояние Эйнштейна Бору по поводу копенгагенской интерпретации, или Бора – Гейзенбергу в отношении к матричной механике? Умнейшие люди, а по факту – сплошные страсти-мордасти[11].

Впрочем, не в меньшей степени завораживают продюсеров и сценаристов социальные игры (и я бы даже сказал, драмы), разворачивающиеся между представителями новых индустрий. В качестве наглядной иллюстрации можно посмотреть американский сериал «Замри и гори»[12], или, если хочется чего-нибудь повеселее, то уже упомянутую мной «Силиконовую долину». Конечно, в главных ролях технари и бизнесмены от новых технологий – люди «объективного мира», так сказать… Но Homo sapiens’y это никогда не помогало.

А теперь давайте задумаемся, как бы дико это ни звучало, о социальности искусственного интеллекта. Понятно, что искусственный интеллект (ИИ) – это просто такой «класс», у этого «класса» множество «подвидов», а у каждого подвида есть свои «индивиды».

Например, вы даёте какому-то ИИ-индивиду задачу общаться с другими ИИ-индивидом, и в рамках этого общения они должны будут поделить между собой две книги, одну шляпу и три мяча. Эти ИИ-индивиды (в данном случае – боты), конечно, ничего не знают о ценности того, что они делят, но мы будем подкреплять баллами их поведение, если им будет удаваться быстро и успешно договариваться.

Именно эту задачу и поставили ботам в 2018 году специалисты отдела Facebook по исследованию возможностей искусственного интеллекта (FAIR). И сначала всё шло прекрасно.

ИИ-Боб, например, предлагал ИИ-Алисе: «You get one book and ГМ take every thing else». Алиса предусмотрительно отвечала: «No way, I need all 3 hats». «ГП give you 2», – говорил Боб в ответ, и ребята договаривались.

Flo в какой-то момент этот задушевный диалог стал странным образом видоизменяться и наконец превратился в нечто совершенно невообразимое.

Вот фрагмент стенограммы этого разговора двух искусственных интеллектов, «сошедших с ума»:

Bob: i can i i everything else…………..

Alice: balls have zero to me to me to me to me to me to me to me to me to

Bob: you i everything else…………..

Alice: balls have a ball to me to me to me to me to me to me to me

Bob: i i can i i i everything else…………..

Alice: balls have a ball to me to me to me to me to me to me to me

С каждой следующей строкой текст всё более и более усложнялся, а масштабы коммуникации между Бобом и Алисой росли буквально в геометрической прогрессии.

|

|

Испуганные сотрудники отдела исследований суперспособностей, – ой, простите, – способностей искусственного интеллекта просто вырубили машину от греха подальше.

Последующий анализ показал, что ИИ-индивидуумы, участвующие в этих своеобразных виртуальных торгах, перешли на более удобный для них язык. На кону стояли баллы, которые они могли заработать, а английский язык, как оказалось, не так уж хорош. И боты на ходу придумали свой, категорически непонятный их собственным разработчикам язык.

Лингвисты Пенсильванского университета показали, что новый язык, изобретённый ботами в этих торгах, вовсе не бессмысленен: там, где, как нам кажется, идёт повтор фразы, на самом деле меняется порядок слов, и собеседник в своих ответах каждый раз реагирует на эти изменения, что свидетельствует о том, что для него они несут разный смысл.

Проще говоря, два предельно примитивных бота, обменивающиеся, по сути, ничем за ничто, могут воспользоваться друг другом, чтобы этот процесс шёл лучше!

Перед нами, иными словами, самая настоящая социальная коммуникация, которая, надо сказать, выглядит куда более осмысленной и продуктивной, чем обычная – наша с вами.

Мы недооцениваем способность искусственных интеллектов к кооперации и, напротив, слишком переоцениваем свою – человеческую – социальность, нашу способность объединять усилия, действовать по-настоящему совместно и скоординированно.

Наши амбиции, продиктованные животной природой человека, его иерархический инстинкт и извечные притязания на власть, когнитивное искажение «владения»[13] и прочий инстинктивно-когнитивный сор зачастую превращают нашу социальность в проблему, а вовсе не в ресурс.

Впрочем, и это ещё не всё.

Согласно знаменитым теперь уже исследованиям оксфордского профессора Робина Данбара, мозг человека эволюционно приспособлен к достаточно тесному, конструктивному и более-менее регулярному взаимодействию лишь со 150 другими особями («число Данбара»).

И даже эти отношения неравномерны – с большинством наших визави мы взаимодействуем лишь шапочно: плотность этих отношений (например, совместное времяпрепровождение) убывает фазово – пять человек, пятнадцать, пятьдесят и потом сразу сто пятьдесят (так называемые «слои Данбара»).

|

|

По-настоящему интенсивный, глубокий и содержательный контакт мы способны поддерживать лишь с пятью людьми, которые выступают перед нами как фигуры на фоне остальной социальной массы – образов других людей, создаваемых нашим мозгом. И да, этот фон составляют всего лишь оставшиеся 145 субъектов.

Антропологи, в свою очередь, указывают, что для наших сообществ на ранних этапах развития человечества долгое время существовала непреодолимая черта в 200 человек.

Как только какое-то племя (сообщество) достигало этого рокового порога численности, оно неизбежно делилось как минимум на две группы, и между ними, прежними соплеменниками, тут же начинались боевые действия. То есть существует ещё и некое групповое ограничение, влияющее на нашу социальность.

Теперь, если коротко подытожить: мы ограничены не только своей физиологией, не только своей индивидуальной социальностью, но и социальностью групповой.

Это, безусловно, серьёзнейшая проблема с точки зрения переработки информации, создания смыслов, формирования новых, более сложных интеллектуальных объектов.

Возможно, искусственные интеллекты усвоят какие-то наши пороки.

Вот, например, тренер Watson’a Эрик Браун однажды «скормил» своему подопечному словарь городского жаргона. Тот тут же накинулся на новую базу данных и естественным образом связал узнанные им матерные слова с медицинской терминологией. В результате он стал выдавать такое, что несчастные исследователи чуть не надорвали животы. Впоследствии всё это безобразие пришлось вычищать вручную, потому что сам Watson отказался отдавать полюбившиеся ему «термины» так же просто, как получил их.

В «аморальности», впрочем, замечены не только машины IBM, но и Microsoft. Её специалисты, совместно с сотрудниками Кембриджского университета, создали систему Deep Coder, цель которой понятна из названия. Как говорит один из её создателей Марк Брокшмидт, «люди, не умеющие программировать, теперь могут просто описать свои идеи, а программа их закодит».

Выглядит очень логично и как следующий шаг к технологической сингулярности. Ирония в том, что Deep Coder стал вести себя очень по-человечески: не обнаружив нужных ему участков кода в своей базе данных, он, вместо того чтобы проделать необходимую работу кодера самостоятельно, стал «подворовывать» необходимые ему фрагменты кода у других программ.

Это уже социальность высшего порядка – Deep Coder ловко встал на плечи «гигантов» и, кажется, не хочет останавливаться на достигнутом. Да, у машин, очевидно, не будет свойственных нам ограничений, влияющих на эффективность коммуникации, а такая транспарентность вполне может дать взрывной результат.

|

|

Наконец, вспомним про «трансгуманистические технологии»… Не так-то просто заставить наш мозг видеть вне видимого спектра, слышать то, к чему наш слух эволюционно не предназначен, и так далее. Но у компьютера, разумеется, подобных проблем нет и быть не может. Он способен даже видеть нас изнутри с помощью нехитрых, по его меркам, приставок типа магнитно-резонансной томографии.

В общем, по техническим параметрам нам лучше даже не пытаться с ним соревноваться. Если искусственный интеллект по уровню своего развития дотянет хотя бы до нашего – честно признаемся, не слишком высокого, – то он уже будет несравнимо умнее нас.

Поэтому, если пользоваться принятыми на вооружение классификациями, даже общий искусственный интеллект (ОИИ) – это существо уже значительно более мощное, чем мы с вами. Что уж тогда говорить о сверхмощном искусственном интеллекте, который нам вроде как тоже обещают?

Надеюсь, что я ещё не очень замучил вас рассказами о том, какие мы все с вами идиоты по сравнению с «тупыми» машинами… Понимаю, что даже думать об этом – дело весьма утомительное. Но надо набраться сил, поскольку дальше нам предстоит, возможно, самое интересное.

Ладно там физические параметры нашего «железа», слабые сенсоры и убогая социальность и т. д. Есть ведь ещё и собственно устройство нашего мозга, то, как он думает. Этот вопрос мы до сих пор весьма деликатно обходили стороной…

Языковая игра

Существует и такая языковая игра: изобретать имя для чего-нибудь.

ЛЮДВИГ ВИТГЕНШТЕЙН

Мне неоднократно приходилось слышать такого рода возражения: мол, какой у машины может быть интеллект? Это же просто набор алгоритмов, созданных человеком!

Забавно. Да, есть и «бузина», и «в Киеве дядька» тоже может быть, но слово – это только слово, и в зависимости от контекста оно может обозначать совершенно разные вещи.

Недаром мой любимый философ Людвиг Витгенштейн говорил, что не существует никаких «философских проблем», а есть лишь неразрешённые «языковые игры».

Проще говоря, если вы разберётесь, в каких словах вы запутались, то и проблемы, скорее всего, исчезнут сами собой.

Автором магического теперь уже словосочетания «искусственный интеллект» по праву считается Джон Маккарти. Но не от хорошей жизни искусственный интеллект стал «искусственным интеллектом». Придумать название для чего-то, чего раньше никогда не было, но чтобы любой человек, по системе ассоциаций, быстро понимал, о чём идёт речь, – это непросто очень.

Маккарти понимал, что есть феномен, который нуждается в номинации – в назывании. Об этом феномене рассуждали в 40-50-х прошлого века все великие умы, увлечённые идеей программируемых компьютеров: создатели самой идеи компьютеров – Алан Тьюринг и Джон фон Нейман, автор «теории информации» Клод Шеннон, пророк «кибернетики» Норберт Винер… Рассуждали, но единого имени для этого феномена не было.

При этом математики (а на первых порах это в основном были, понятное дело, математики) – люди увлекающиеся, мыслящие сложными абстрактными конструктами. С человеческим языком у них, как правило, дела обстоят не очень.

Так что на роль названия для феномена, который мы знаем теперь как «искусственный интеллект», претендовали достаточно странные слова и словосочетания.

Например, понятие «автоматов» («исследование автоматов»). Фон Нейман, с которым Маккарти обсуждал свою идею, занимался «клеточными автоматами», а Шеннон, взявший Маккарти к себе на работу в Bell Labs, выпустил книгу об «автоматах», которую Маккарти даже пришлось редактировать[14].

То есть были все шансы у искусственного интеллекта называться, например, «умным автоматом», что, вероятно, многих его критиков примирило бы с действительностью мгновенно. Впрочем, в этом случае о другого рода «автоматах» шла бы речь – о математических, не об оборудовании с газировкой, но кого бы это смутило?

Было на повестке, конечно, и всякое «кибернетическое», а также «комплексная обработка информации», «машинный интеллект» и т. д.

Понятие «автоматы» Маккарти забраковал, потому что оно адресовало к математическим абстракциям (даже если это кому-то кажется забавным, это так).

Ничто а-ля кибернетическое Маккарти не нравилось, потому что основоположника кибернетики – Норберта Винера – он считал напыщенным занудой и думать не хотел о том, чтобы иметь с ним дело. В общем, как-то само собой нарисовалось слово «интеллект».

Но хотел ли Маккарти намекнуть нам на некое подобие мыслительной функции человека и этого своего «искусственного интеллекта»?

Как выясняется, нет. Впоследствии он не раз писал и говорил, что область, которую он обозначил «искусственным интеллектом», не имеет отношения к поведению человека – это просто такое слово-образ.

Но слово вылетело – не поймаешь: термин «искусственный интеллект» стал ассоциироваться с заменой человеческого разума машинным, о чём на самом деле речи-то и не шло.

Идея названия состояла не в прямой связи, не в замене и даже не в дополнении человеческого интеллекта искусственным (хотя уже тогда это и стало происходить), а в аналогии: у человека есть некая интеллектуальная функция принятия решений, и у машины есть нечто подобное – неживое, как и сама машина, искусственное.

В общем, математики, собравшиеся в 1956 году в рамках Дартмутского летнего исследовательского проекта, организованного Джоном Маккарти при финансовой поддержке Фонда Рокфеллера, подвоха не почувствовали, проголосовали – и название «искусственный интеллект» шагнуло в мир.

Показательно, кстати, что в программе этой конференции не было никаких докладов, которые были бы как-то связаны с поведением человека или его интеллектом.

Сейчас нет ни одного форума по искусственному интеллекту, где бы не говорили о биологическом интеллекте, механизмах мозга, обратной эмуляции коннектома[15] и тому подобных вещах. Но для Маккарти подобные вещи выглядели бы глупо и совершенно неуместно на конференции по «искусственному интеллекту».

Когда он и его коллеги обсуждали «искусственный интеллект», они вовсе не воображали себе тех роботов из голливудских блокбастеров, к которым мы за это время уже так привыкли. Они говорили о чём-то своём… Но о чём именно?

Чтобы понять это, давайте посмотрим на ставшие уже классическими примеры искусственного интеллекта – да, слабого, но полностью отражающего существо феномена.

В 1998 году Ларри Пейдж, под руководством своего наставника Терри Винограда и в соавторстве с Сергеем Брином, опубликовал в IEEE Data Engineering Bulletin статью под названием «Что можно сделать с сетью в кармане?», где была сформулирована концепция будущей поисковой системы Google – по тем самым легендарным уже гиперссылкам.

Уже через несколько месяцев предприимчивые Пейдж с Брином ушли из Стэндфордской лаборатории и основали свою компанию, которая теперь обладает главным в мире интернет-поисковиком.

Но успех их проекта – это не какое-то единичное техническое решение двух удачливых стэнфордских магистрантов, а гигантский искусственный интеллект, изо дня в день осуществляющий сложнейшую работу по ранжированию и выдаче страниц, мониторингу сайтов и поведения конкретных пользователей, продаже рекламы и т. д., и т. п.

Количество искусственных интеллектов, созданных Google за два десятка лет, вообще-то говоря, колоссально.

Вот взять, например, Google Translate – это самообучающийся и постоянно совершенствующийся искусственный интеллект. Изначально ему было предложено соотнести десятки тысяч документов, которые за долгие годы были созданы на различных языках бесчисленными переводчиками Организации Объединённых Наций.

Это оказалось блестящим решением – где ещё отыщешь такое огромное количество текстов, которые с предельной точностью одновременно переведены на огромное количество национальных языков?

Искусственный интеллект Google подошёл к делу технически безукоризненно: он обнаружил в продублированных на разные языки текстах множество взаимосвязей, корреляций и соотношений и, можно сказать, буквально научился на этих языках говорить.

Теперь, когда вы предлагаете Google Translate перевести какой-то текст, он не просто вываливает на вас набор слов из бесчувственного словаря, а строит фразу, причём не только используя известные ему алгоритмы, но и параллельно совершенствуя их, самообучаясь.

«Получив предложение на английском языке и запрос перевода на немецкий, сервис сканирует все известные ему документы на английском и немецком, ищет точное совпадение и затем возвращает соответствующий текст на немецком языке. […] Компьютеры оценивают статистические закономерности в больших массивах ранее накопленного цифрового контента, создание которого потребовало больших затрат, но воспроизведение их не стоит почти ничего».

ЭРИК БРИНЬОЯФСОН, директор Центра цифрового бизнеса MIT, ЭНДРЮ МАКАФИ, социолог и экономист из MIT

Является ли такого рода «интеллектуальная» работа собственно интеллектом? И да, и нет. Если достаточно грубо обобщить то, что делает какой-нибудь Google Translate, то ситуация выглядит следующим образом:

• на его условный сенсор приходит некая информация, которую он должен сначала как-то распознать, идентифицировать, а потом отреагировать на неё;

• чтобы придумать адекватную реакцию на этот идентифицированный им как-то раздражитель, он должен сопоставить её с каким-то своим опытом – с тем, что он уже знает;

• он обращается к своей базе данных (своему «опыту») и находит некое соответствие, и производит реакцию – некое поведение, а проще говоря, предлагает перевод слова или фразы.

Если вы имеете хоть какое-то представление о том, как развивалась психотерапевтическая наука, а слова «бихевиоризм» и «когнитивно-поведенческая психотерапия» для вас не пустой звук, то вы уже понимаете, что мы имеем дело с классической моделью психики.

ПСИХОТЕРАПЕВТИЧЕСКИЕ РАЗВИЛКИ

Когда говорят о психотерапии, то первым делом вспоминают, конечно, классический психоанализ. Фигура Зигмунда Фрейда и правда была грандиозной, а думать о сексе, согласитесь, куда приятнее и привычнее, чем о чём-либо ещё. Но психоанализ ни в практическом, ни в концептуальном плане не выдержал испытания временем. Это красивая теория, но она ненаучна.

Наука начинается с нейрофизиологии – с наших соотечественников И. М. Сеченова, И. П. Павлова, А. А. Ухтомского, Л. С. Выготского, А. Р. Лурии, П. К. Анохина… Об открытиях этих великих учёных я уже много раз рассказывал в других своих книгах, а здесь нас интересуют лишь общие схемы – на них и остановимся.

Конец ознакомительного фрагмента. Купить полную версию.

Примечания

1

Вот лишь небольшой их список: ВИЧ, заражение людей птичьим гриппом, геморрагические лихорадки (Эбола и др.), новые разновидности вирусного гепатита и т. д.

2

Проект «Геном человека» (The Human Genome Project, HGP) – это научно-исследовательский проект по расшифровке последовательности нуклеотидов, составляющих ДНК (порядка 25 тыс. генов). Проект был начат в 1990 году под руководством нобелевского лауреата Джеймса Уотсона, а также Национальной организации здравоохранения США, и стал одной из крупнейших международных научных коллабораций.

3

Термоядерный синтез – получение более тяжёлых ядер элементов с выделением огромного количества дешёвой энергии.

4

Впрочем, это лишь логика рассуждений, которую предлагает нам Рэй Курцвейл. Справедливости ради отмечу, что, согласно знаменитому прогнозному перечню IBM «5 in 5», к 2030 году в городах развивающихся стран будет проживать более 80 % населения. Кто ошибается, а кто прав – пока непонятно.

5

По иронии судьбы, а может и закономерно, тут снова не обошлось без Курцвейла: над обучением Watson'a медицинским специальностям работает медицинская школа штата Мэриленд, Колумбийский университет и компания Nuance Communications, которая была первым стартапом Курцвейла и называлась тогда Kurzweil Computer Products.

6

Добавлю, что в 2015 году компании Google и Johnson&Johnson объявили о совместном проекте по производству робота-хирурга, который, по их заверениям, будет многократно превосходить возможности Vinci Xi.

7

Не буду, впрочем, утруждать вас деталями: что, почему и зачем, Рэй Курцвейл подробно рассказывает в книге «Transcend: девять шагов на пути к вечной жизни», которая написана им в соавторстве с тем самым профессором Гроссманом.

8

Silicon Valley – комедийный сериал Дэйва Крински, Джона Альтшулера и Майкла Джаджа для НВО, где с изощрённой изобретательностью высмеиваются все самые актуальные тренды культурной и рабочей среды нынешних аборигенов Силиконовой долины.

9

Рейтинг Нильсена определяет популярность той или иной телевизионной программы.

10

Квалиа (от лат. qualia – свойства, качества) – это один из любимейших терминов «философов сознания», который обозначает то, как вещи выглядят для нас – в нашем индивидуальном субъективном опыте. Термин был введён в обиход ещё сто лет назад философом К. И. Льюисом, но пережил новое рождение благодаря знаменитой статье Т. Нагеля «Что значит быть летучей мышью?». Сам термин в статье не упоминается, но зато осознание невозможности представить себе субъективный опыт видения мира летучей мышью, действительно, позволяет это «квалиа» прочувствовать.

11

0 том, как это бывает, неплохо, кстати сказать, показано в историко-драматическом сериале «Manhattan» Сэма Шоу, посвящённом истории создания атомной бомбы в рамках Манхэттенского проекта в Лос-Аламосе. Сериал продержался три сезона на канале WGN America.

12

Сериал «Halt and Catch Fire» создан Крисом Кантвеллом и Крисом Роджерсом для канала АМС и повествует обо всех ключевых этапах становления современных компьютерных технологий.

13

Об этом эффекте и его социальных последствиях я уже рассказывал в книге «Красная таблетка. Посмотри правде в глаза!». Как показали нобелевские лауреаты Ричард Талер и Даниэл Канеман, из-за определённых эволюционных настроек мы склонны переоценивать себя, ценность своего имущества и вклад в общую деятельность в два раза, а то и больше по сравнению с условным «номиналом». Данное когнитивное искажение приводит к постоянным конфликтам между людьми, осуществляющими какую-либо совместную деятельность.

14

Теория автоматов – это раздел дискретной математики, который изучает вычислительные машины, представленные в виде математических моделей. Автомат по заданному алгоритму преобразует дискретную информацию по шагам в дискретные моменты времени.

15

Эмуляция коннектома предполагает перевод данных, собранных в результате подробного картирования всех связей мозга, в цифровую форму, позволяющую использовать эту модель для воспроизводства интеллектуальной деятельности эмулируемого мозга.

|

|

|

Механическое удерживание земляных масс: Механическое удерживание земляных масс на склоне обеспечивают контрфорсными сооружениями различных конструкций...

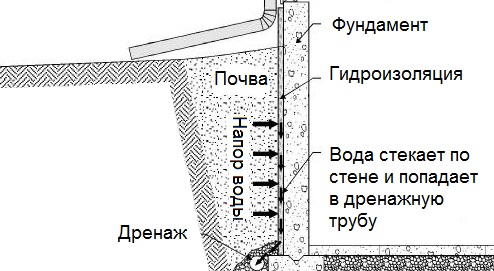

Общие условия выбора системы дренажа: Система дренажа выбирается в зависимости от характера защищаемого...

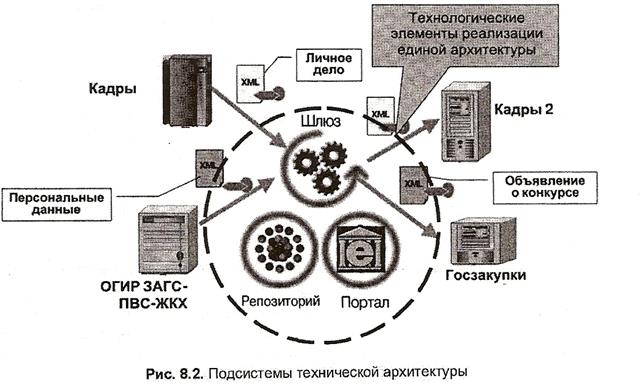

Архитектура электронного правительства: Единая архитектура – это методологический подход при создании системы управления государства, который строится...

Типы оградительных сооружений в морском порту: По расположению оградительных сооружений в плане различают волноломы, обе оконечности...

© cyberpedia.su 2017-2024 - Не является автором материалов. Исключительное право сохранено за автором текста.

Если вы не хотите, чтобы данный материал был у нас на сайте, перейдите по ссылке: Нарушение авторских прав. Мы поможем в написании вашей работы!